SCI论文(www.lunwensci.com):

摘要:多品种花类的识别在生活、贸易中具有广阔的应用前景,为解决大众人群准确分辨花类品种较为困难的问题,本文提出一种基于ResNet34网络的花类识别方法,在对数据样本进行泛化处理后,在网络残差结构中加入注意力机制,并对相关参数进行微调整,再利用迁移学习训练网络模型。实验表明,本文方法不仅有效的加快了模型训练的收敛速度,同时准确率比ResNet34原网络提升了5.2个百分点,达到了95.3%,并且相比于同类型较为成熟的分类网络,如AlexNet、VGG16、GoogLeNet,本文方法识别准确率有着显著提升。

关键词:花类识别;ReNet34;迁移学习;注意力机制

Identification of Flower Species Based on Attentional Mechanism and Transfer Learning

GAO Shidi,YANG Mingyue,JIANG Dan,TAO Jun

(School of Artificial Intelligence,Jianghan University,Wuhan Hubei 430056)

【Abstract】:Many types of flower type recognition have broad applications in life and trade.In order to solve the mass population accurately distinguish flower varieties comparatively difficult problems,this dissertation puts forward a type of based on ResNet34 network class identification method,after to generalize the data sample,join in the network structure of residual attention mechanism,and the related parameters are micro adjustment,then transfer learning and training network model is used.Experiments demonstrate that the proposed method not only accelerates the convergence speed of model training effectively,but also improves the accuracy by 5.2 percentage points compared with ResNet34 original network,reaching 95.3%.Compared with the mature classification networks of the same type,such as AlexNet,VGG16,GoogLeNet,the recognition accuracy of the proposed method is markedly enhanced.

【Key words】:flower identification;ReNet34;attention mechanism;transfer learning

0引言

在花类识别领域,传统花类识别方法存在着精度低、识别成本高等问题,诸多学者开始尝试利用深度学习技术来替代传统方法进行识别。林君宇等[1]利用多输入层卷积神经网络来对花类及其病症进行分类,识别率为88.2%,在使用迁移学习[2]后其识别率提升至94.4%,但是其花卉叶部数据集规模较小,在进行特征提取时对样本特征提取的不够充分;吴丽娜等[3]将LeNet-5网络中部分池化层结构进行调整,利用随机梯度下降法和Dropout方法,在Oxford-17数据集上识别精度达到了96.5%,但是其没有考虑到颜色是否会对识别精度造成影响,其文中没有此类实验。

鉴于以上分析,以上花类识别研究都存在一定局限性,本文提出一种基于ResNet34网络的花类识别方法,首先对数据样本进行泛化处理,增加数据样本规模;其次在网络残差结构中加入注意力机制;最后利用迁移学习训练网络模型。为得到针对本文数据集最合适的策略组合,本文设计两组对比实验,记录训练参数,分析各个网络的训练效果。

'

在国际ImageNet竞赛中,一系列性能优异的图像分类网络模型相继被提出,例如:AlexNet[4]、VGG16[5]、GoogLeNet[6]。根据CNN(卷积神经网络)[7]领域以往的实验可得,网络层数越深,对特征信息的学习就会越丰富。为解决深层网络训练中后期出现的梯度消失、网络退化、梯度爆炸等问题,何凯明等提出了ResNet[8]网络。ResNet由一系列残差块构成,又依据残差块的数量差异构成了如:ResNet(18、34、50、101)等网络结构,并且其具有优异的学习能力,准确率较此前其他网络有着大幅提升。

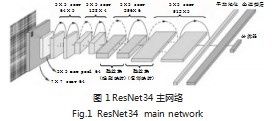

经试验ResNet34在本文数据集上取得了准确率和训练速度的完美平衡,故本文选定ResNet34作为主干网络。如图1所示为ResNet34主网络构图。

1.1注意力机制

注意力机制(Attention Mechanism)由通道注意力(Channel attention)和空间注意力(Spatial attention)组成[9]。通道注意力机制使用平均池化和最大池化来聚合传入的特征图中的信息,而后在共享网络层中使用逐个元素求和的方式输出所得的特征向量,通道注意力机制结构如图2(a)所示。空间注意力机制主要关注特征图之中花类的坐标信息,其可以对通道注意力信息进行有力的补充,空间注意力机制结构如图2(b)所示。

1.2迁移学习

由于收集到的花类品种的样本数量较少,与ResNet论文中所使用的数据集样本数量相差较多,若想达到较好的训练效果,需要比较庞大的训练数据支撑。为解决此问题,本文采取了迁移学习[10]的方法。迁移学习作为机器学习的一个重要分支,侧重于将已经学习过的知识迁移应用于新的问题中。迁移学习的核心思想是,找到新问题和原问题之间的相似性[11]。

2基于注意力机制和迁移学习的ResNet34网络模型设计

为了解决本文数据集样本数量较少从而导致图像特征学习较为困难的问题,本文在ResNet34中引入了注意力机制以及迁移学习。

2.1将注意力机制应用于ResNet34

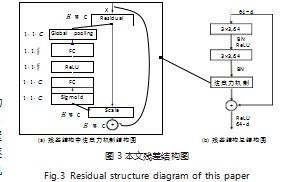

本文将注意力机制与ResNet34网络模型结合起来,在重点关注花类图像通道信息的同时,提取出较为全面的特征信息。其中,残差结构中注意力机制模型结构图如图3左所示,结合注意力机制后的残差结构图如图3右所示。

2.2将迁移学习机制应用于ResNet34

本文利用ResNet34网络模型在ImageNet大型数据集上进行预训练,而后基于共享相关参数的方式对花类品种进行识别、分类。本文裁剪去除ResNet34预训练模型中的输出层和全连接层,仅保留具有相同参数结构的池化层、卷积层。重新建立全连接层和5个分类输出与保留的池化层、卷积层相连接,从而得到一个迁移学习在ResNet34网络模型上的应用,如图4所示。

3实验结果及分析

3.1实验数据及环境

本文数据集尺寸为224×224×3,共为5个类别,每个类别存为一个文件夹,并以花类名称作为文件夹名称。其中,菊花(633张)、玫瑰花(641)、向日葵(699)、郁金香(799)、蒲公英(898张),总计3670张。将数据集随机按照6∶1的比例随机划分为:训练集3170张图,测试集500张图,其中花类样本示例如图5所示。

本文实验环境为:Windows10专业版操作系统,AMD R7-4800处理器,内存16G,NVIDA GeForce RTX 2060显卡,Python解释器版本为3.7.11,深度学习框架为Pytorch1.9.0。

3.2 ResNet层数对试验的影响

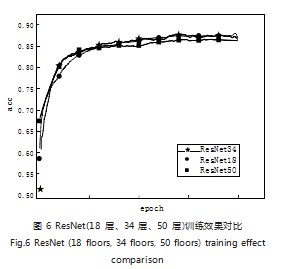

为了对比ResNet不同层数(如ResNet18、ResNet34、ResNet50)在花类数据集上的训练效果,本文设置实验对以上三种网络模型准确度进行对比。初始学习率设为0.0001,Batch大小为32,迭代200次,ResNet18、ResNet34、ResNet50三种网络模型在本文花类数据集上训练的实验结果如图6所示,其中训练效果总结如表1所示。

由图6(经曲线平滑处理后)可得,ResNet34网络训练效果明显优于ResNet18、ResNet50网络。

由表1可得,在相同训练环境下,ResNet34网络准确率最高。综合考虑准确率及训练时长等因素后,本文选用ResNet34作为主网络模型。

3.3 ResNet34与同类型识别网络准确率对比试验

将ResNet34与AlexNet、VGG16、GoogLeNet等较为成熟的分类网络在本文花类数据集上的训练效果进行对比,结果如图7所示,其中训练效果总结如表2所示。

从图7(经曲线平滑处理后)可以看出,ResNet34网络模型训练表现明显好于其余三种网络模型。在训练过程初期,ResNet34模型能快速的进行收敛,在Epoch为100的时候,就已经获得较好的训练效果,而同Epoch条件下,其余三种网络模型准确率较低,收敛速度相对缓慢。

由表2可以看出,AlexNet网络模型训练速度稍快,但是准确率较低。ResNet34在训练时间与AlexNet、GoogLeNet相差不大的情况下,准确率远高于其余三种网络。

综上所述,在考虑到准确率和训练时间成本的情况下,ResNet34网络模型表现明显优于其余三种网络。

3.4 ResNet34改进前后对试验的影响

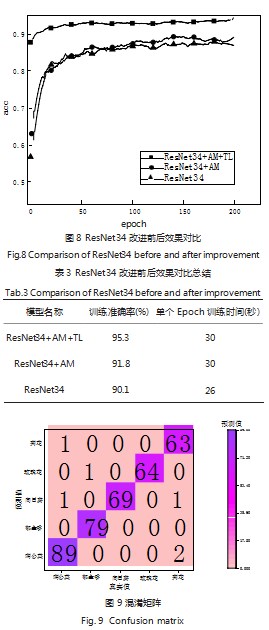

本文对ResNet34网络结构进行微调,在残差结构中加入注意力机制,并基于ResNet34网络在ImageNet数据集上的训练权重进行迁移学习。将改进后的ResNet34网络与ResNet34原网络训练效果进行对比,Epoch为200,训练效果对比如图8所示,其中训练效果总结如表3所示,其中AM代表注意力机制(Attentional Mechanism)缩写,TL代表迁移学习(Transfer Learning)缩写。

由图8(经曲线平滑处理后)可以看出,在ResNet34网络中加入注意力机制(AM)后,训练准确率有1.7个百分点的提升。

由表3可以看出,注意力机制、迁移学习方法对于ResNet34网络模型学习能力的提升较大,在训练数据样本匮乏的情况下有着优异的表现。

为验证本模型实际预测效果,本文利用混淆矩阵对预测效果进行展示,坐标系X、Y轴刻度分别对应本文数据集中的5种花类名称,负对角线上的值表示各个种类测试样本数量,其余坐标值代表模型对某一品种花类的预测错误数量。混淆矩阵如图9所示。

由图9可知,对于蒲公英,有两个样本预测结果出现了偏差,对于郁金香,有一个样本预测结果出现了偏差,对于菊花,有3个样本出现了偏差。检查偏差样本后可知,由于个别样本图像与其他品种较为相似,从而导致模型预测出现误判,对于其余两种花类(向日葵、玫瑰花),本文模型预测达到了100%准确率。

4结论

本文提出一种基于ResNet34网络模型的花类识别方法,在对数据样本进行泛化处理后,在网络残差结构中加入注意力机制,并对相关参数进行微调整,再利用迁移学习训练网络模型。

实验表明,综合考虑训练时间成本、训练准确率之后,选用ResNet34网络作为主网络模型。在用改进之后的ResNet34网络与原ResNet34网络进行对比实验后,可以得出,改进后的ResNet34网络较原网络训练准确率提高了5.2个百分点。

本文的改进方法在准确率方面有着较为明显的提升,在不影响网络模型准确率的前提下,后续的工作将研究如何精简模型结构,降低参数量,加快训练速度。

参考文献

[1]林君宇,李奕萱,郑聪尉,等.应用卷积神经网络识别花卉及其病症[J].小型微型计算机系统,2019,40(6):1330-1335.

[2]杨莲,石宝峰.基于Focal Loss修正交叉熵损失函数的信用风险评价模型及实证[J].中国管理科学,2022,30(5):65-75.

[3]吴丽娜,王林山.改进的Le Net-5模型在花卉识别中的应用[J].计算机工程与设计,2020,41(3):850-855.

[4]KRIZHEVSKY A,SUTSKEVER I,HINTON G E.Image Net Classification with Deep Convolutional Neural Networks[J].Communications of the ACM,2017,60(6):84-90.

[5]SIMONYAN K,ZISSERMAN A.Very Deep Convolutional Networks for Large-scale Image Recognition[J].Computer Science,2014.

[6]SZEGEDY C,LIU W,JIA Y Q,et al.Going Deeper with Convolutions[C]//Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition,2015:1-9.

[7]邓伟,闫诺,郑志强,等.基于双路卷积神经网络在甲状腺结节良恶性鉴别诊断中的初步研究[J].中国临床医学影像杂志,2022,33(4):235-239.

[8]HE K M,ZHANG X Y,REN S Q,et al.Deep Residual Learning for Image Recognition[C]//Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition,2016:770-778.

[9]孙卫红,杨程杰,邵铁锋,等.基于MSRCR与注意力机制的群体蚕茧智能识别算法[J].丝绸,2022,59(6):58-65.

[10]杨一,高社生,胡高歌.基于敏感度方差重要性的RBF神经网络结构优化算法[J].控制与决策,2015,30(8):1393-1398.

[11]郭永存,张勇,李飞,等.嵌入空洞卷积和批归一化模块的智能煤矸识别算法[J].矿业安全与环保,2022,49(3):45-50.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/50915.html