SCI论文(www.lunwensci.com):

摘要:随着国家建设“平安城市”规划的提出,交通安全和城市治安管理变得尤为重要。而轮胎花纹图像分类在交通事故及刑侦破案取证中具有重要的作用。本文提出一种基于注意力机制和迁移学习的轮胎花纹分类方法。通过自适应直方图均衡化对于输入的轮胎图片进行数据增强,使轮胎花纹纹理与背景部分对比更加显著。通过迁移学习,减少训练时间,通过改进ResNet50模型,融合通道空间注意力机制提高了模型对于轮胎花纹纹理的特征提取能力。通过实验证明,该模型对于轮胎花纹分类,其最高精度可以达到96.41%,表明有较强的泛化能力。

关键词:自适应直方图均衡化;注意力机制;迁移学习;残差网络

Tire Classification Based on Attention Mechanism and Transfer Learning

CHEN Hanqi,HAN Yonghua

(Zhejiang Sci-Tech University,Hangzhou Zhejiang 310018)

【Abstract】:With the national construction of"Safe City"plan put forward,traffic safety and urban public security management has become particularly important.Tire pattern image classification plays an important role in traffic accidents and criminal investigation and evidence collection.This paper proposes a tire pattern classification method based on convolutional neural network and transfer learning.Data enhancement is performed on the input tire image through adaptive histogram equalization,so that the contrast between the tire pattern texture and the normal part is more significant.Through transfer learning,the training time is reduced.By improving the ResNet50 model and integrating the channel spatial attention mechanism,the feature extraction ability of the model for tire tread texture is improved.Experiments show that the model can achieve a maximum accuracy of 96.41%for tire pattern classification,indicating that it has a strong generalization ability.

【Key words】:adaptive histogram equalization;attention mechanism;transfer learning;residual network

0引言

轮胎花纹图像在刑事犯罪案件侦破中往往能够为警方的调查提供重要线索。为了能够提高警察工作效率,实现高效的轮胎花纹分类技术显得格外重要。此外,在轮胎制造的商业领域,也时常因轮胎花纹侵犯专利权而发生商业纠纷。轮胎花纹图像纹理丰富、边缘清晰、不同型号的轮胎花纹视觉效果相似,故常采用纹理特征表征[1]。Liu Y[2]利用亮度直方图统计矩的改进Tamura特征表征图像。JIA Shiying[3]在描述轮胎花纹的纹理构成时引入方向测度的灰度共生矩阵(Gray Level Co-occurrence Matrix)与离散小波变换(Discrete Wavelet Transform,DWT)。Yan[4]为了获取图像纹理特征使用了Radon变换和双树复小波变换(Dual Tree-complex Wavelet Transform,DT-CWT)。Wang Shuai[5]提出将DWT与尺度不变特征相结合的轮胎图像表征算法。传统方法提取的纹理特征是对图像内容的低层表示,缺乏视觉特征和高层语义特征,从而导致语义鸿沟。为了解决这一问题,需要对于轮胎花纹分类问题进行智能化分类。而随着深度学习技术的快速发展,卷积神经网络由于其运算特性已广泛应用在图像分类任务中,近年来,许多学者对卷积神经网络进行了深入研究,并取得了研究成果。Alex[6]等提出了AlexNet模型,该模型引入全新的深层结构和Dropout方法,大大降低错误率,颠覆了图像识别领域;赵秦敏提出VGG模型[7]通过小卷积核不仅能够增加网络的深度,还能减少网络参数量。除此之外,比较经典的卷积神经网络还有GoogleNet[8]、ResNet[9]等。但当数据集较小时,一旦加深模型结构,就很有可能出现模型过拟合的问题,并且从零开始训练整个模型也需要花费大量的时间和计算资源,此外以上网络对于细节特征提取也存在缺陷。于是本文先进行CLAHE图像预处理,并提出基于注意力机制和迁移学习的轮胎花纹分类方法,通过注意力机制提高网络对于细节特征提取,使用迁移学习方法大大减少训练时间和计算资源,并加快网络的收敛速度,避免过拟合。

1图像预处理

1.1自适应直方图均衡化(CLAHE)

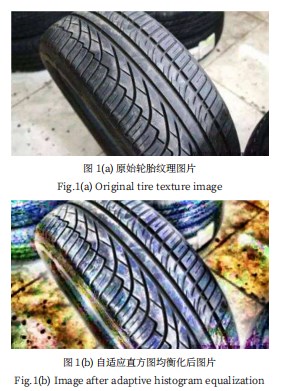

如图1(a)所示,原始轮胎图片由于整体图片颜色较为单一,颜色等级分布较为集中,使得轮胎花纹纹理特征容易收到背景环境等噪声的影响。直方图均衡化[10]是一种使图像的颜色分布更佳均匀的变换方法。根据信息论,信息的熵越大,包含的信息也就越多,熵的计算公式如式(1)所示:

所以当p(xi)分布较均匀时,熵的值较大。对应到图像上,当图像直方图能够较均匀分布时,图像对比度较大,以此来实现增强轮胎花纹特征的效果。并且为了防止部分区域由于对比度增强过大,成为噪点。通过设置直方图分布的阈值,将超过该阈值的分布“均匀”分散至概率密度分布上,由此来限制转换函数(累计直方图)的增幅。此外,通过插值算法来提升计算效率。由于这一过程虽然增加了线性插值的计算量,但是却大大降低了变换函数的计算次数,所以提高了计算速度。最终得到变换前后效果如图1所示。

1.2增强数据集

本次原始数据集收集了来自于Kaggle公开数据集和网络,为了防止网络的过拟合并增加网络的泛化能力,我们通过旋转、裁剪、曝光等数据增强方法,通过一张图片生成许多张衍生图片并加入数据集,来增加本次数据集的图片数量。

2网络设计

2.1迁移学习

纹理分类的精准度是提高轮胎花纹纹理判断的前提条件,若使用深度学习方法,需要采用大量的轮胎花纹图像数据集作为样本训练深度学习模型来解决轮胎花纹图像识别分类问题,当数据集较小时,一旦加深模型结构,就很有可能出现模型过拟合的问题,这样训练得到的模型泛化能力不足,从而导致在验证集上得不到较高的准确度。并且如果从零重新开始训练整个模型也需要花费大量的时间和计算资源,相对来说比较困难,所以本文采用迁移学习[11]来解决以上问题。

本文使用在ImageNet这一庞大数据集上训练好的模型参数进行初始化,而不是对于模型参数进行随机初始化。冻结出来全连接层之外的其他层所有神经元的值,保持网络其他参数不变,修改网络的全连接层,在自己的数据集上对于全连接层重新进行训练。这样可以用较小的学习率来训练整个网络。

2.2迁移网络选择

深度卷积神经网络中常用的图像分类模型有很多,例如:AlexNet、VGG、GoogLeNet、ResNet、DesneNet[12]和PReLU-Net[13]等。自何凯明提出残差网络后,卷积网络模型的深度便大大增加,从而导致大幅提升了模型的分类精度。如表1所示为几类有代表性的深度学习模型在ImageNet数据集上训练得到的Top-1 error、Top-5 error的大小。

在表1中,模型的Top-1 error和Top-5 error值越小,说明模型在图像分类方面的准确率越高。由表1在ImageNet数据集上的Top-1和Top-5准确率上看ResNet 50在准确率上具有一定的优势。虽然有准确度更高如DesneNet[12]这样更大结构和更加复杂的网络,但是更深层次的网络过于庞大,对于网络训练的硬件环境要求更高,所以本文选择ResNet50作为基础网络。

2.3通道空间注意力机制

注意力机制最初用于自然语言处理领域[13],现在注意力机制也越来越多地应用于计算机视觉领域,计算机视觉中的注意力机制主要是使模型把注意力放在感兴趣的区域,关注图像中有助于判别的信息而忽略掉不相关的信息。本文采用了一种结合了空间和通道的软注意力机制模块(CSAM)[14]如图2所示。

这是一种为卷积神将网络设计的,简单有效的注意力模块(Attention Module)。对于卷积神经网络的特征图(Feature Map),CBAM从通道和空间两个维度计算特征图的注意力图(Attention Map),然后将注意力图与输入的特征图相乘来进行特征的自适应学习。对于特征图F∈RC*H*w,CBAM将会顺序推理出一维的通道注意力和二维的空间注意力图过程如式(2)、式(3)所示:

其中⊗为逐个元素之间相乘,MC为通道注意力处理,Ms为空间注意力处理。首先将通道注意力模块的输出(Channel Attention Map)与输入(Feature Map)相乘得到F',之后计算F'的空间注意力模块的输出(Spatial Attention Map),并将两者相乘得到最终的输出F''。

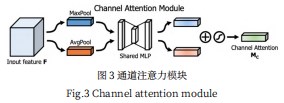

特征图的每个通道都被视为一个特征检测器,通道注意力模块主要关注于输入图片中对于轮胎纹理分类重要的区域如:纹理的深度、形状等,如图3所示。

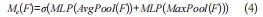

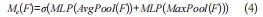

通道注意力模块使用最大池化和平均池化对特征图在空间维度上进行压缩,得到两个1×1×C的特征图,再将它们分别送入一个两层的MLP神经网络,其中第一层神经元个数C/r,其中r为减少率,激活函数为Relu,第二层神经元个数为C,这个两层的神经网络是共享的。随后将MLP输出的特征进行基于逐元素的加和操作,再经过Sigmoid激活函数,生成最终的通道注意力特征,即MC。最后,将MC和输入特征图F做逐元素乘法操作,生成后面的空间注意力模块需要的输入特征。计算公式如式(4)所示:

空间注意力模块主要关注于位置信息,如图4所示。

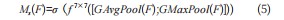

我们会对输入进来的特征层,在每一个特征点的通道上取最大值和平均值。之后将这两个结果进行一个堆叠,利用一次通道数为1的卷积调整通道数,然后取一个Sigmoid,此时我们获得了输入特征层每一个特征点的权值(0-1之间)。在获得这个权值后,我们将这个权值乘上原输入特征层即可,计算公式如式(5)所示:

经过CBAM模块之后我们会获得一个和输入特征图尺寸大小完全相同的输入,并将得到的输出作为后面池化层和全连接层的输入。

2.4轮胎花纹分类网络结构

本文采用ResNet50网络作为基本的网络结构进行迁移学习,将CSAM注意力机制模块添加在池化层和全连接层前面,CSAM注意力机制可以提高网络对感兴趣的区域特征的提取能力,可以增强图像特征表征能力,关注图像的重要特征而抑制不相关的特征。为了降低过拟合,在网络全连接层的中添加了Dropout层,改进后的用于轮胎花纹分类任务的模型网络结构如图5所示。

3实验

3.1数据分析

本次实验所用的数据集来源于Kaggle公开数据集和网络,数据集中有10种不同花纹的图片,总共有1324张图片数量,在不同环境和不同拍摄条件下的轮胎纹理图片。对于数据集按照7:2:1的比例分配训练集、测试集和验证集。

3.2模型训练

首先将得到的图片进行CLAHE变换,增强对比度,提高纹理特征。在实验过程中将数据集随机打乱后训练,所以每一次读取图片的顺序都是不同的,一共训练了50个Epoch,批次样本数Batchsize是模型进行迭代训练时处理图片的数量,其值越大,模型的收敛速度就越快,训练时间就越短,但是占用的显存会越多,这里根据实际情况设置Batchsize大小为32。在文本实验中,我们尝试了Adam和SGD两种不同优化器对于模型收敛和优化程度的影响。实验表明Adam优化器比SGD能获得更高的精度且收敛的更快,因此模型的优化器选用Adam。具体训练流程如图6所示。

3.3实验结果分析

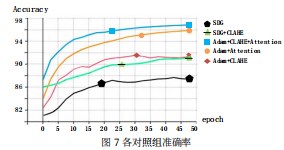

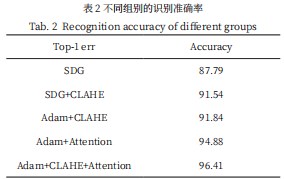

本文所有实验均在Windows10使用GPU实现,软件环境为Cuda11.1、Python3.6.0、Pytorch1.9.1。首先搭建ResNet50模型,载入预训练的ResNet50模型权重文件,冻结特征提取层参数,去除原始ResNet50模型中的全连接层,添加注意力模块,使得特征可以获得不同的权重,添加Dropout层和新的全连接层。对ResNet50模型改进后,加载轮胎花纹数据集,在搭建好的PyTorch环境中进行模型训练,将训练过程中每轮迭代的准确度等数据保存到日志文件中,然后使用Tensorboard绘制在验证集上的Accuracy变化曲线,为了验证本文所提方法的有效性,我们做了5组对照实验组,分别为图像不进行CLAHE处理并使用SDG优化器;采用SDG优化器和CLAHE处理但不增加注意力机制;采用Adam优化器和CLAHE处理但不采用注意机制;采用Adam优化器但不增加Attention机制,以及本文所提出方案。最后绘制结果如图7和表2所示,其中表2准确率为训练过程中最优准确率。

从图中可以得到,由于使用迁移学习以ImageNet上得到的模型权重作为特征提取层参数,模型从一开始就可以获得一个较好的准确度,并随着训练次数的不断变化,模型通过注意力机制获取轮胎花纹特征而使得准确度进一步提高。并且,从上表对照每组的结果可以看出本文提出的每一个方法,在实验过程中均取得了正面的反馈,可以加强模型对于轮胎纹理分类模型的准确度和收敛速度。

4结论

本文针对传统轮胎图像表征算法缺乏视觉特征和高层语义特征的缺陷,提出了基于迁移学习,融合通道空间注意力机制,改进ResNet50网络结构的轮胎花纹分类算法,提高了轮胎花纹分类的识别精度,有效改善了轮胎花纹分类识别的智能化和自动化水平。本次实验训练了一个用于轮胎花纹分类的模型,采用迁移学习的方法选取性能较好的模型进行调优改进,经过50个Epoch迭代,缩短了从零开始训练模型的时间,最终的模型识别准确率在96.41%以上,模型在轮胎花纹分类方面有较好的泛化能力。

参考文献

[1]HUANG D Y,HU W C,WANG Y W,et al.Recognition ofTire Tread Patterns Based on Gabor Wavelets and Support Vector Machine[C]//International Conference.DBLP,2010:92-101.

[2]LIU Y,LI Z,GAO Z M.An Improved Texture Feature Extraction Method for Tyre Tread Patterns[C]//International Conference on Intelligent Science and Big Data Engineering.Springer Berlin Heidelberg,2013:705-713.

[3]JIA S Y,MA J T.Tire Pattern Retrieval Based on Wavelet Transform and Gray Level Co-occurrence Matrix[J].Computer Measurement&Control,2016:210-213.

[4]YAN H Y,LIU Y.An Improved Texture Feature Extraction Method Based on Radon Transform[C]//International Symposium on Computational Intelligence and Design,2014:481-485.

[5]WANG S,LIU Y,LI D X,et al.An Improved SIFT Feature Extraction Method for Tyre Tread Patterns Retrieval[C]//Seventh International Symposium on Computational Intelligence and Design,2014:539-543.

[6]Alex Krizhevsky,Ilya Sutskever,Geoffrey E Hinton.ImageNet Classification with Deep Convolutional Neural Networks[J].Communications of the ACM,2017,60(6):84-90.

[7]Karen Simonyan,Andrew Zisserman.Very Deep Convolutional Networks for Large-Scale Image Recognition[J].Computer Science,2014.

[8]SZEGEDY C,LIU W,JIA Y Q,et al.Going Deeper with Convolutions[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).IEEE,2015.

[9]HE K M,ZHANG X Y,REN S Q,et al.Deep Residual Learning for Image Recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition(CVPR).IEEE,2016.

[10]MA J X,FAN X N,YANG S X,et al.Contrast Limited Adaptive Histogram Equalization-Based Fusion in YIQ and HSI Color Spaces for Underwater Image Enhancement[J].InternationalJournal of Pattern Recognition and Artificial Intelligence,2018,32(7):1-26.

[11]Sinno Jialin Pan,Yang Qiang.A Survey on Transfer Learning[J].IEEE Transactions on Knowledge and Data Engineering,2010,22(10):1345-1359.

[12]HUANG G,LIU Z,WEINBERGER K Q,et al.Densely Connected Convolutional Networks[C]//IEEE Conference on Computer Vision and Pattern Recognition.Hawaii:IEEE,2017:2261-2269.

[13]HE K M,ZHANG X Y,REN S Q,et al.Delving Deep into Rectifiers:Surpassing Human-Level Performance on ImageNet Classification[J].IEEE Computer Society,2015:1026-1034.

[14]陈榕,任崇广,王智远,等.基于注意力机制的CRNN文本分类算法[J].计算机工程与设计,2019,40(11):3151-3157.

[15]WOO S,PARK J,LEE J Y,et al.CBAM:Convolutional Block Attention Module[C]//The European Conference on Computer Vision,2018:3-19.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/42020.html