SCI论文(www.lunwensci.com)

摘要: 目前现有的农业机器人大多应用于大范围农田, 大部分温室大棚 、小范围农田主要依靠人工种植辅以小型传统机械, 存在 功能缺失 、适应性不强等问题 。为此设计了一种小型农业机器人用于大棚内农作物播种 、施肥 、浇水及病虫害检测 。首先采用卷 积神经网络 (CNN) 特征提取方法实现了机器人循迹功能, 通过卷积神经网络自主提取图像特征, 提高了机器人循迹适应力; 然 后通过主控制器 (ATmega2560) 及相关硬件实现了农业机器人挖土 、播种 、施肥 、浇水功能; 最后基于 MobileNetV2-SSD 轻量化 网络设计了农作物病虫害检测功能, 结合倒残差 (Inverted residual block) 与深度可分离卷积, 在降低模型参数量的同时保证了模 型精度 。 实验验证了设计方法的合理性, 表明该多功能机器人具有良好的综合适用性, 提高了机器人使用率, 同时降低了劳动者 的工作强度, 具有良好的应用前景和推广价值。

关键词 :农业机器人,卷积神经网络,病虫害检测,特征提取,农业生产

Design and Realization of a Small Multifunctional Agricultural Robot

Xu Siyu1. Lyu Donghui1 ※, Shan Zhong1. Zhao Feng2. Zheng Yuzhou1. Li Shiheng1

( 1. Tianjin Sino-German University of Applied Sciences, Tianjin 300350. China; 2. Tianjin University of Technology, Tianjin 300384. China) Abstract: Currently, most of the existing agricultural robots are used in large-scale farmland . Most greenhouses and small areas of farmland aremainly done by hand with small traditional machinery, which has problems such as lack of functionality and poor adaptability . A small agricultural robot was designed for crop sowing, fertilizing, watering, and detecting pests and diseases in greenhouse. Firstly, the convolutional neural network (CNN) feature extraction method was used to achieve the robot tracking function, and the convolutional neural network was used to extract image features independently, improving the robot tracking adaptability; then, the main controller (ATmega2560) and related hardware were used to implement the functions of digging, sowing, fertilizing, and watering for agricultural robots; finally, based on the MobileNetV2-SSD lightweight network, a crop pest detection function was designed, combining inverted residual block and depth separable convolution to reduce the amount of model parameters while ensuring model accuracy . The experiment shows that the average accuracy (mAP) of the algorithm used on the disease and insect pest dataset disclosed by AIStudio is 81%, and the single frame time on the EdgeBoard computing card is about 27 ms. The rationality of the design method is verified, indicating that the multifunctional robot has good comprehensive applicability, improves the utilization rate of the robot, and reduces the work intensity of workers. It has good application prospects and promotion value.

Key words: agricultural robot; convolutional neural network; pest detection; feature extraction; agricultural production

0 引言

我国幅员辽阔, 农业一直是我国发展的重心, 随着 农业机械化水平的提高, 机械化产品如拖拉机 、收割机 等在农业生产中被广泛应用, 大大提高了生产效率[ 1]。 但这些大型机械主要应用在大田中, 在小范围土地上 种植农作物的地方如温室大棚等, 仍然依赖人工劳作, 设备也是以半自动化为主的小型机械, 如除草机 、播种 机等。

针对小型农业工作机器人的设计, 卡内基梅隆大学 团队[2-4]利用激光雷达和立体双摄像头实现果园机器人的 自主导航 。孙元义等[5]对图像进行分割并利用 Hough 变换获得导航路径 。周茉等[6]利用图像融合技术, 结合模糊 控制理论设计了可以自主规划路径的小麦播种机器人, 实现表明该机器人能实现自主避障, 完成最优路径规划, 提高了小麦的播种效率 。Oberti 和 Ulbrich 等[7]设计喷雾末 端执行器, 实现完全自动化的药物喷洒 。Cavender-bares 等[8]设计基于激光雷达和 GPS 定位的施肥机器人, 可根 据不同情况对土壤两侧进行适量施肥。

传统的农业机器人只能实现农作物播种 、除草等单 一功能, 单一的功能设计影响了机器人的使用效率; 基 于 GPS 定位 、传统机器视觉图像处理的巡航方案鲁棒性 差 、适应性不强, 易受环境影响。

为了解决上述问题, 本文设计一种小型农业机器人 用于大棚内农作物播种 、施肥 、浇水 。整体实现农作物 耕种等系列操作一体化; 利用卷积神经网络导航算法[9] 相较于传统方法表现效果更好, 使用少量数据便可实现 自主导航 。另外, 还针对农作物生产周期内出现的病虫 害问题, 设计了病虫害检测及农药喷洒功能, 提高了机 器人使用效率, 减轻了人力管理成本。

1 总体方案设计

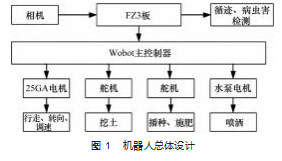

农业机器人由车架 、行走机构 、播种机构 、水泵机 构 、末端执行器 、Wobot 控制器 、EdgeBoard 计算卡和摄 像头等组成 。该机器人采用四轮式行走机构, 以 Wobot 控制器控制 25 GA 电机驱动, 使得机器人能够在田埂上 行驶; 通过舵机能够带动末端执行器上下移动, 末端执 行器采用双爪式且内部为波浪形的设计机构, 能够对土 壤进行抓取和释放; 播种机构由舵机控制播种器门的开 合, 实现对种子的播撒; 水泵机构来完成对农作物的浇 水任务 。机器人的顶部和侧面分别有一个摄像头, 顶部 的摄像头对田埂进行识别让机器人在田埂上行驶, 侧方 摄像头可以对农作物进行病虫害检测, 并返回信息 。机 器人总体设计如图 1 所示。

2 机器人机械结构设计

2.1 车架设计

车架主要由 6 根三排梁组成, 用螺丝将其中 4 根三排架连接构成主车架起支撑作 用 。 车 架 内 部 装 有 4 个25 GA 电机用于驱动轮子旋转 。车架上方有 2 根三排梁与侧面的 2 根三排梁垂直放置, 用螺丝将其与主支架相连, 起 承 载 其 他 装 置 的 作用 。车架设计如图 2 所示 。

2.2 机器人挖土装置设计

掘土装置主要由机械爪和机械臂组成, 并置于机器 人左侧车架上, 机械爪由两组三手指构成, 通过舵机来 控制夹紧和松开动作, 机械爪固定在机械臂上, 机械臂由伺服电机控制从而带动机械爪的抬起和放下 。挖土装 置结构如图 3 所示。

2.3 播种装置设计

播种装置由种仓盒 、播种滑道和控制门组成, 种仓 盒下端和播种滑道相连, 连接处种仓盒开口由控制门遮 挡, 种仓盒用绑带固定在机械臂左侧, 控制门与舵机相 连, 舵机通过绑带固定在 Wobot 控制器的支架上 。通过 人工将种子倒入种仓盒内, 然后由舵机控制控制门的开合 从而实现种子的播撒和结束 。播种装置结构如图 4 所示。

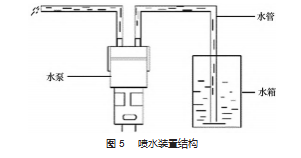

2.4 喷洒装置设计

喷洒装置由水箱 、软水管 、水泵组成 。水泵实物如 图 5 所示 。水泵由绑带固定于机器人右后方支架上, 水 箱侧方开小口置于机械臂后方由绑带固定, 并通过软水 管与水泵进水口相连接, 水泵出水口由另一根经过改装 从而能够实现喷洒功能的软水管引出, 管口朝向车左下 方 。喷洒装置如图 5 所示。

3 机器人硬件设计

3.1 驱动电机的设计

大棚地势平坦, 所以选择简单灵活的四轮式行走结 构 。机器人采用四轮驱动, 四轮驱动稳定性强, 机器 人运动过程不会产生很大的偏移, 每个电机安装一个 100 mm 橡胶轮子, 使机器人抓地更牢固 。本设计选用 25 GA 电机用于驱动机器人运动, 电机空载转速340r/min, 空载电流 190 mA, 效率点 23% 。驱动电机如图 6 所示 。

3.2 相机选择

相机是机器视觉系统中的一个关键组件, 选择合适 的相机不仅直接决定所采集到的图像分辨率 、图像质量等, 同时也与整个系统的运行模式直接相关 。本文选择 USB 接口的单目相机, 设计前向相机用于采集机器人前 方路径图像用于循迹, 同时设计侧向相机用于采集田地 农作物图像用于病虫害检测 。相机实物如 7 图所示。

3.3 主控制器的选择

Wobot 控制器是上海鲸鱼机器人科技有限公司研发 的最新一代控制器, 具有高性能 、低功耗 、接口丰富、 可 开 源 控 制 、体 积 小 且 稳 定 可 靠 等 特 点 。 本文设计 Wobot 控制器用于控制摄像头拍摄 、电机驱动 、水泵抽水 等功能。Wobot 控制板实物如图 8 所示。

3.4 FZ3 模型移植板

EdgeBoard FZ3 是米尔与百度紧密合作推出的一款基 于 Xilinx Zynq Ultrascale CZU3EG 芯片打造的深度学习计 算卡, 芯片内部集成了 4 核 ARM A53 处理器+GPU+FPGA 的架构, 具有多核心处理能力 、FPGA 可编程能能力以 及视频流硬件解码能力等特点; 内置了基于 Linux 操作 系统+百度深度学习平台-飞桨 (Paddle) 定制的深度学 习软核, 可高效 、快速地实现模型的训练—部署— 推理 等一系列流程 。FZ3 板实物如图 9 所示 。主要调用流程: ( 1 ) 应用程序获取视频输入; (2 ) 调用预测库加载模型; ( 3 ) 调度模型和底层驱动加速模块进行计算; (4 ) 获得 运行结果。

4 机器人软件设计

本文的机器人控制设计主要包括机器人循迹控制, 机器人挖土 、播种 、施肥 、浇水控制及机器人病虫害检 测控制 。本文基于卷积神经网络算法, 通过训练循迹、 转向 、病虫害图像数据集得到训练模型, 将模型移植到 FZ3 板, 通过摄像机采集图像控制机器人进行相应动作 。 4.1 卷积神经网络算法卷 积 神 经 网 络 (Constitutional Neural Networks,CNN ) 是在多层神经网络的基础上发展起来的针对图像 分类和识别而特别设计的一种深度学习方法 。卷积神经 网络是一种前馈神经网络, 目前是深度学习领域常用的 神经网络结构之一 。常见的 CNN 网络结构包括多个卷积 层+池化层, 用于图像特征提取, 通过激活函数对特征 图像进行非线性处理并将特征映射传输到下一层。后面通 过全连接层+softmax 结构用于特征分类 。CNN 在结构上权值共享 、局部连接以及空间或时间上的降采样 3 个特征, 这些特性有效降低了网络模型参数的复杂度 。卷积神经网络由输入层 、隐藏层 、输出层 3 个部分组成, 模型如图 10 所示。

4.2 机器人循迹控制设计

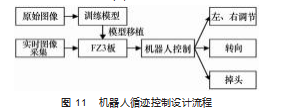

传统图像处理方法用于循迹设计对采集的图像质量 要求较高, 且需要进行图像预处理人工提取图像特征, 增 加了设计复杂度[10] 。本设计研究基于卷积神经网络训练的 机器人寻迹控制, 采用卷积神经网络自主提取图像特征方 法, 实现机器人在田间的运动控制 。本设计选用 8 层卷积 神经网络, 其中前 5 层网络用于提取图像特征, 后 2 层全 连接层用于融合图像特征, 最后一层全连接输出结果。

机器人在田地里中共有 3 种运动要求, 即当机器人 位置偏移时能进行左右调节 、机器人行驶到终点时向左 转向及掉头 。对于左右方向调节, 机器人通过前端相机 拍摄路径图像, 每张照片所对应的类别数据和手柄摇杆 对应, 即- 1 到 1. 当机器人判断类别为 0 到- 1 时, 根据 程序, 机器人会判断自己位于理想路线的左侧, 然后会 根据偏移量而改变的自己的方向, 同理当机器人判断类 别为 0. …, 1 时, 也会根据偏移量改变方向, 直到机器 人沿直线行驶; 当机器人前端相机拍摄到转角图像时, 机器人判断类接近于- 1. 机器人执行左转操作; 当机器 人前端相机拍摄到掉头图标时, 机器人进行掉头操作 。 机器人循迹控制流程如图 11 所示。

4.3 机器人播种程序设计

本设计模拟大棚内农作物种植场景, 共设置 3 垄田 地 。农业机器人从田垄右侧的田埂开始处出发, 机器人 顶部摄像头对前方路径识别, 使机器人机器人走在田埂 中央位置, Wobot 控制板通过对时间和速度计算出路程 后, 走过 50 cm 路程时停止, 此时伺服电机控制机械臂 放下, 舵机控制机械爪对土壤进行抓取动作, 形成播种坑, 然后机器人前进 5 cm 后停止, 舵机控制播种器的控 制门抬起 30 °, 种子从播种滑道落入播种坑种, 随后机 器人后退 5 cm 停止, 舵机控制机械爪松开, 土壤落下将 播种坑填满, 机器人再前进 50 cm 重复前面的播种任务, 每列田垄长 260 cm, 共播撒 5 次 。第一列田垄播撒完后, 顶部摄像头识别到田垄末端时, 机器人执行转弯动作, 然后直行进入第二列的田埂, 通过水泵从水箱中抽水对 第一列田垄执行浇水任务, 走到第二列田埂末端时摄像 头识别到掉头标签, 此时停止浇水, 机器人执行掉头任 务, 重新进入第二列田埂, 对第二列田垄进行播种和浇水 任务, 当三列田垄全部完成播种和浇水任务后, 机器人从 最左侧田埂直行退出菜地。机器人播种流程如图 12 所示。

4.4 机器人病虫害检测设计

4.4. 1 病虫害检测方法研究

Barbed 等[ 11] 通过数字图像处理方式, 提出了一种基 于色彩变换 、颜色直方图和基于两两分类系统的疾病判 别方法, 专门处理大量的病虫害图片 。通过对图像三通 道中绿色通道的占比判断农作物的健康状况。

李子茂等[ 12]研究了基于深度学习的月季病虫害检测 算法, 使用改进的 YOLOv3 模型对月季多叶片病虫害图像 进行检测, 实验表明该方法能有效减少复杂背景的影响。

丁小奇[13]研究了基于图像处理的蔬菜叶片病虫害检 测方法, 利用边缘检测算法提取病虫害图像的纹理特征, 使用了 HSV 颜色空间提取蔬菜叶片病虫害图像的颜色特 征, 构建图片特征向量库用于模型的训练, 实现对叶片 病虫害的检测。

采用传统的图像处理方法用于病虫害检测, 需要人 为提取病虫害图像特征, 而人为提取图像特征主观性强, 不具有广泛适用性 。采用卷积神经网络方法用于病虫害 检测是研究热点, 通过自主提取图像特征的方法, 极大 地减少了人为因素的干扰 。 目前常用的卷积神经网络检 测模型有 YOLO[ 14] 、SSD[15] 、Faster-RCNN[16]等, SSD 模 型融合了 YOLO 和 Faster-RCNN 的优点, 均衡了两种方 法的检测速率和识别准确率, 整体性能好。

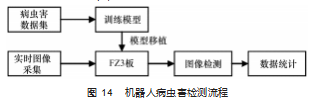

4.4.2 SSD 检测算法

SSD 模型包括特征提取网络和检测识别网络两个组 成部分 。特征提取网络是由基础网络和辅助结构组成的, 主要负责对输入图像提取不同尺度的卷积特征图, 以便 进行后面的多尺度预测[ 17] 。传统的 SSD 网络以 VGG16 模 型作为特征提取网络, 由于 VGG16 模型使用了 3 次全连接层, 这样大大提高了模型参数量大, 需要消耗更多的 硬件资源 。2019 年, BISWAS D 等[18]将 Mobilenet 模型与 SSD 算法相结合, 设计了基于 MobileNet-SSD 的铁路信号 灯检算法, 在保证识别精度的条件下, 降低了模型参数 量, 提高了算法性能 。MobileNet-SSD 算法结构主要包括 图像输入 、特征提取网络 、分类和回归层及输出层, 算 法模型如图 13 所示。本设计基于 MobileNet-SSD 模型训练用于病虫害检 测的模型 。机器人在田间行驶并拍摄实际图像, 通过模 型检测图像中的病虫害目标, 并进行数据统计 。机器人 病虫害检测流程如图 14 所示。

5 机器人制作及实验

本文根据上述设计完成了如图 15 的机器人, 该机器 人为 280 mm(长)×170 mm(宽)×450 mm(高) 。实验通过 机器人相机拍摄包括转向 、掉头和左右调节位置等 9 000 张实际行驶图像, 通过 400 次模型训练得到用于循迹的 模型 。将机器人放置到田垄右侧, 根据程序设计, 机器 人进行播种 、施肥 、浇水操作, 如图 16 ~ 18 所示 。小车 根据循迹程序设计, 直到整块田地播种等操作完成。由于环境因素的影响, 实验未采集到农作物病虫害 图像 。实验从网上收集了 1 000 张农作物叶片病虫害图像 集, 其中 800 张用于模型训练, 数据集如图 19 所示。

通过 300 次模型训练得到用于病虫害检测的网络模型, 由于环境的影响并不能采集实际的病虫害农作物用 于模型测试, 实验选取 200 张病虫害图像用于模型测试, 整体识别率达到 81%, 满足检测要求 。实际使用中, 机 器人对整块田地完成病虫害检测, 通过计算病虫害图像 占总拍摄图像的比值来判断田地里的病虫害等级, 当病 虫害检测率超到 30% 时, 小车自动进行农药的喷洒进行 病虫害治理。

6 结束语

本文主要设计了一种适用于大棚内工作的小型多功 能机器人, 该机器人实现播种 、施肥 、浇水功能, 并针 对农作物生产期出现的病虫害问题, 设计了病害虫检测 功能 。本机器人在设计上采用基于卷积神经网络的方法 用于机器人循迹, 使用传统图像处理对原始图像要求较 高, 本文采用的方法能提高机器人循迹适应能力 。在病 虫害检测方面, 本文将 MobileNet-SSD 算法应用到病虫 害检测上, 通过机器人视觉采集农作物图像, 通过模型 检测实现检测功能, 并对检测数据进行分析, 当识别病 虫害到达一定程度时, 对农作物进行喷农药治理 。本设 计实现了农业机器人的多功能一体化, 但也存在着一些 不足之处: 由于机器人体积较小, 机器人灵活较差; 由 于病虫害数据集图像不足, 实验训练的检测模型识别率 较低, 且没有使用真实的病虫害数据集, 实验还需要进 一步补充数据集; 目前机器人只适用大棚内部环境, 如 果想要将它应用于大面积农田还需要对该机器人进行一 定的改进; 机器人还增加更多的功能, 如除草 、收割农 作物等。

参考文献:

[ 1] 田维翼,杨磊, 宋欣,等 . 一种太阳能种植机器人的设计与实现[J]. 天津农学院学报,2021.28(2):60-66.

[2] Marcel Bergerman,Silvio M Maeta,Ji Zhang,et al.Robot Farmers: Autonomous Orchard Vehicles Help Tree Fruit Production. [J]. IEEE Robot. Automat. Mag.,2015.22( 1): 54-63.

[3] Bergerman M,Singh S,Hamner B. Results with autonomous vehi ‐ cles operating in specialty crops[J]. Proceedings IEEE Interna ‐ tional Conference on Robotics & Automation,2012:1829- 1835.

[4] Wang Q I,Nuske S,Bergerman M,et al. Automated Crop Yield Es ‐ timation for Apple Orchards[J]. Springer International Publishing,2013.

[5] 孙元义, 张绍磊,李伟 . 棉田喷药农业机器人的导航路径识别 [J]. 清华大学学报(自然科学版),2007(2):206-209.

[6] 周茉, 张学明, 刘志刚 . 小麦精播机器人设计——基于图像融 合与智能路径规划[J]. 农机化研究,2016.38(6):26-30.

[7] Oberti R, Marchi M, Tirelli P, et al. Selective spraying of grape ‐ vines for disease control using a modular agricultural robot[J]. Biosystems Engineering,2016:203-215.

[8] Cavender-Bares K, Bares C C. ROBOTIC PLATFORM AND METHOD FOR PERFORMING MULTIPLE FUNCTIONS IN

AGRICULTURAL SYSTEMS: US20130325242[P]. 2013.

[9] 王科俊,赵彦东,邢向磊 . 深度学习在无人驾驶汽车领域应用 的研究进展[J]. 智能系统学报,2018. 13(1):15.

[10] 岳俊峰,李秀梅 . 基于机器视觉的智能机器人自动循迹及避障 系统[J]. 杭州师范大学学报(自然科学版),2020. 19(2):200-207.

[ 11] Barbedo J GA, KoenigkanL V, Santos T T. Identifying mltiple plant diseases using digital image processing[J]. Biosystems en ‐ gineering,2016. 147:104- 116.

[ 12] 李子茂,刘恋冬,夏梦,等 . 基于深度学习的月季多叶片病虫害 检测研究[J]. 中国农机化学报,2021.42(8):169- 176.

[13] 丁小奇 . 基于特征检测的蔬菜叶片病虫害识别模型研究[D]. 长春:吉林农业大学,2020.

[ 14] Redmon J , Divvala S , Girshick R ,et al. You Only Look Once: Unified,Real-Time Object Detection[J]. Computer Vision & Pat ‐ tern Recognition,2016.

[15] Liu W, Anguelov D, Erhan D, et al. SSD: Single Shot MultiBox Detector[J]. Springer,Cham,2016.

[16] Ren S, He K, Girshick R, et al. Faster R-CNN: Towards Real- Time Object Detection with Region Proposal Networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence,2017. 39(6):1137- 1149.

[ 17] 毛家顺 .SSD 卷积神经网络在 SAR 图像目标检测中的应用研 究[D]. 西安:西安电子科技大学,2018.

[18] BISWAS D, SU H, WANG C, et al. An automatic traffic density estimation using Single Shot Detection SSD and Mobile Net- SSD[J]. Physics and Chemistry of the Earth,20l9.l10:176184.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/ligonglunwen/61556.html