SCI论文(www.lunwensci.com)

摘 要 :针对车载 360 环视应用场景对实时性的较高要求,提出了一种基于嵌入式设备的高效环视融合方案。该方案结合 了环视图像矫正、俯视变换和环视融合三个步骤,建立了采集到的原始图像与最终环视图像之间的像素查找关系,并在多种车 载嵌入式平台上进行了验证。结果表明 :该方法相比传统方法能够有效降低图像处理的计算量,从而大幅降低嵌入式设备的环 视融合延时,优化后平均每帧处理的时间可缩短至优化前的二分之一以下。

Design of an Efficient Software Scheme for Vehicle-mounted 360-degree Surround

View Fusion Based on Em

LI Chulin, FU Ying, CHEN Xin, YANG Zhaoyang

(The Key Laboratory of Automotive Power Transmission and Electronic Control of Hubei, Hubei University of Automotive Technology, Shiyan Hubei 442000)

【Abstract】:Aiming at the high real-time requirements of vehicle-mounted 360-degree surround view applications, an efficient surround view fusion scheme based on embedded devices is proposed. The scheme combines three steps: Surround image correction, top-view transformation, and surround view fusion, establishing a pixel lookup relationship between the collected raw images and the final surround view images, and verifying it on multiple vehicle-mounted embedded platforms. The results show that compared with traditional methods, this method can effectively reduce the computational burden of image processing, thus significantly reducing the surround view fusion delay of embedded devices. The average processing time per frame after optimization can be shortened to less than half of the original processing time.

【Key words】:embedded system;vehicle 360 surround view;image fusion

0 引言

近年来, 随着交通安全问题的日益严重, 以机器视 觉为核心技术的汽车主动安全系统已广泛应用于汽车行 业。其中,利用多路摄像机实时采集车身周围实景图像, 并进行图像处理和拼接为全景环视,是最为流行的技术 之一。相较于传统的后视镜、分屏影像系统和倒车影像 等辅助安全驾驶功能,全景环视技术能够实时地向驾驶员提供无盲区的汽车全景影像,借助视觉增强的方式提 高驾驶安全性,有效避免因视野盲区引发的交通事故, 极大地降低了交通安全事故的风险 [1]。

车载 360 全景环视概念最早由国外的 K.Kato 等人 [2] 于 2006 年提出。国内对该领域的研究起步较晚,主要集 中在 2011 年以后,并得到了迅速发展,其中一部分研 究成果已被转化为产品。近几年研究中, Ching-LungSu[3] 于 2016 年实现了车载环视无缝拼接,采用斜率特 征分割图像,提取矫正特征点,通过在相邻图像拼接相 同特征点完成图像拼接。刘庆豪 [4] 在 2017 年提出了基 于 SIFT 的改进算法, 能够确定环视重合区域的特征提 取方法,并使融合后图像过渡更加自然协调。高帆 [5] 于 2018 年对图像校正算法和图像配准、融合算法进行了 优化和改进,保证了效果和实时性。栾婧 [6] 在比较分 析了多种图像拼接算法的优缺点后,选择了 SURF 算法 作为核心算法来拼接图像,提出了简化算法来寻找接缝 并拼接,从而大大减少了计算量。何惠洋 [7] 于 2020 年 较为系统地研究了车载全景环视系统在图像处理过程中 各步骤核心算法的选择,得到了双线性插值法和直接线 性变换算法更适合对图像进行插值校正和俯视变换的结 论, 为算法选择提供了理论支持。2021 年, Al Hami Mo'taz[8] 实现了实时鸟瞰全景系统,且同年李伟等 [9] 设 计开发了罐车全景环视系统,并成功解决了罐车等车型 的全景快速拼接 问题。2022 年, Liang Zuowei 等 [10] 使用 LUT(look-up table) 算法用于车载环视图生成加 速,加快了车载环视帧生成速率。

目前,车载环视的实现主要涉及畸变矫正、俯视变 换和环视融合三个部分 [10]。畸变矫正通常采用张正友 标定法进行,通过标定过程获取的畸变系数与相机内参 实现畸变校正 [11.12]。俯视变换则是利用原始图像与目标 图像之间的四个两两不共线的映射点获取单应性矩阵, 并应用该矩阵进行每一帧图像的像素映射 [13]。环视融 合理论上可以采用四个俯视图像的拼接,但实际上由于 每两幅图像之间的重叠区域较小,导致拼接效果不佳, 且拼接的时间成本较高,因此通常利用标志物将四个俯 视图像的像素点映射到环视图的相应位置,再对重叠区 域进行像素融合的方法进行环视融合 [5]。但是,环视图 像的像素最终来源并不是俯视图像,而是源于采集到的 原始图像。因此, 本文基于 LUT(Look-Up Table) 算 法理论 [14],提出了一种一次性环视像素查找的车辆环 视实现方法,利用此查找关系可以在原始图像上查找每 一帧环视图像的像素点及其融合权重系数,简化了环视 实现的图像处理过程,实现了更高效的车载环视。

1 车载环视流程设计

1.1 相机畸变矫正

为了确保车身周围没有盲区,车辆环视通常使用 4 个或以上鱼眼摄像头 [2]。相较于普通相机,使用鱼眼相 机可以在同一拍摄角度下获取更多的图像信息,从而减 少车身周围摄像头的数量,并降低硬件成本。由于鱼眼 相机需要在相同的画面尺寸下呈现更广阔的视野,常伴随着图像畸变。因此,必须对鱼眼相机所采集图像作出 矫正处理,以提高车载环视系统图像的准确性和可靠性。

在车辆摄像头固定工作完成后,需要使用张正友标 定法 [11] 进行一次相机标定获得相机相关参数,参数主 要有内参矩阵 M3×3、畸变系数 D4×1 与外参矩阵 C3×4.

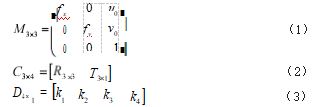

如式 (1)~ 式 (3) 所示 :

式中 :内参矩阵的fx 表示 x 轴方向焦距的像素长 度, fy 表示y 轴方向焦距的像素长度, u0 与 v0 描述了相 机感光板中心在像素坐标系下的坐标, 外参矩阵中 R3×3 表示旋转矩阵, T3×1 表示平移矩阵, k1 · k4 为畸变系数。

确定相机参数后,若忽略鱼眼相机带来的畸变影响, 像素坐标与现实坐标间的关系如式 (4) 所示 :

结合式 (4)~ 式 (5),在鱼眼相机的畸变矫正过程 中,当内参矩阵 M3×3、畸变系数 D4×1 与外参矩阵 C3×4 确定时,矫正图像中每一个像素坐标点均可通过计算得 出在原图中对应的像素坐标,从而完成矫正。

1.2 图像俯视变换

考虑到最终的环视图像是以俯视视角呈现的,而用 于环视的摄像头光轴并非与地面垂直。为了使经过畸变 矫正后的图像视角具有鸟瞰视角,需要将该矫正图像进 行转换。

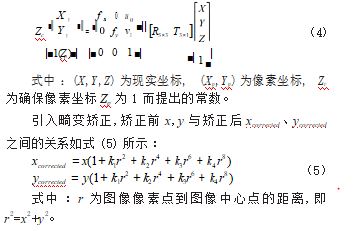

图像的俯视变换是一种透视变换,它将图像投影到 一个新的视平面上 [13]。如图 1 所示为透视变换示意图, 转换关系如式 (6) 所示 :

式 (6) 中 :(xi,yi) 与 (x'i,y'i) 分别是原图与目标图中 的一组匹配点, H3×3 为单应性变换矩阵, hij 为变换矩阵 中的对应值, C 为保证目标图像 z 等于 1 的常数。

在单应性矩阵中,存在 8 个未知数,因此需要使用 4 组两两不共线的匹配点来求解单应性矩阵。只要两者 的视平面不发生变化,该单应性矩阵就可以完成原图与 目标图之间的透视变换。

1.3 环视融合

1.3.1 视图定位

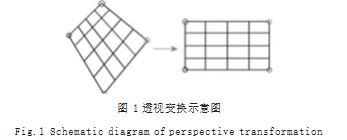

视图定位是在车辆摄像头安装位置固定之后进行的 一次标定工作,依赖于环视图的规划,通常采用 4 个鱼 眼摄像头,各位于前、后、左、右四个方向,环视图的 正中间矩形区域为盲区,如图 2 所示。在上述工作的基 础上进行环视定位标定,即在左前、右前、左后与右后 方的视图重叠区域给出标志点。每个视图中至少需要有 4 个标志点,且每个标志点必须在所有视图中都出现。 利用 4 路透视变换的单应性矩阵,实现矫正图像的俯视 变换并放置进环视图中。

1.3.2 重叠区域融合

对环视图的重叠区域进行接缝融合处理。图像融合 主要有像素级融合、特征级融合和决策级融合 [15]。重叠 区域融合属于像素级融合,常用的像素级融合主要有 : 平均值法、中值滤波法、加权平均法等。为保证图像融 合区域的像素自然过渡,采用渐入渐出加权平均法 [16], 如式 (7) 所示 :

P(x, y) = WA (x, y)PA (x, y) + WB (x, y)(x, y) (7)

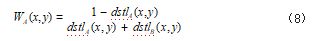

式 (7) 中 :PA (x,y)、PB (x,y) 分别为待融合图像A 在像 素坐标 (x,y) 的 RGB 值、待融合图像 B 在像素坐标 (x,y) 的RGB值; P(x,y) 为融合后图像在像素坐标 (x,y)的RGB 值 ;WA (x,y) 与 WB (x,y) 为权重函数且对应像素坐标位置 两者和为 1.权重函数如式 (8) 所示 :

式 (8) 中 :dstlA (x,y) 为像素坐标 (x,y) 到图像 A 边界 的像素距离, dstlB (x,y) 为像素坐标 (x,y) 到图像 B 边界 的像素距离。

2 车载环视优化算法设计

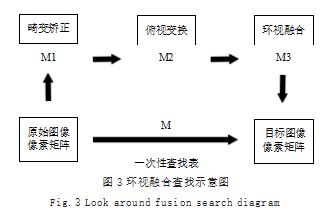

通过畸变矫正、俯视变换和环视融合三个步骤,已 经可以将四路鱼眼摄像头拍摄的图像处理为环视图像。 但是车辆运行时,每一帧环视图像都经过三步处理计算 量较大,考虑到环视图像的像素最终来源于原始图像的 采集,本文提出使用车载环视查找表来省略中间步骤。 该方法需要已确定原始图像与目标图像的转换关系,在 车辆标定完成后,由于环视摄像头的安装是固定的,该 转换关系是已知的,因此,在后续使用中,每一帧环视 图像都需要经过这种转换。若环视图像中像素点个数为 n,该方法可以保证算法时间复杂度稳定为 O(n),同时 省略所有中间步骤,以节省计算时间。如图 3 所示,通 过建立车载环视查找表,可代替畸变矫正、俯视变换和 环视融合计算三个步骤。基于 LUT 理论 [14.17],三个步 骤各可生成一张像素查找表,即单次转换像素查找表,而相邻转化的像素查找表可合并,在此基础上加入辅助 查表方法,即可完成车载环视的一次性查找表建立。

2.1 单次转换像素查找表的建立

当图像 A 与图像 B 之间存在确定的转换关系时, 便意味着图像 B 中的每一个像素点都可以通过这种转换 关系在图像 A 中的相应坐标获得。在这个过程中, 对于 超出图像 A 坐标范围的像素点需设定为初始值。已知图 像 A 需要转换为图像 B 且转换规则fconvent 已知,基于以 下步骤建立单次转换像素查找表 :

Step 1 :获取图像 A 的宽 WA 与高 HA,获取图像 B 的宽 WB 与高 HB。

Step 2 :创建单次转换像素查找表 mapx 与 mapy, mapx 与 mapy 均为 WB ×HB 的单通道图像。

Step 3 :遍历图像 B 中所有像素坐标,在每个像素 坐标处通过对应的转换规则,反求出在图像 A 中的相 应像素坐标。若该像素坐标在图像 A 的范围内,则在 mapx 与 mapy 中相应的像素坐标位置记录该像素坐标 的映射结果 ;若该像素坐标不在图像 A 的范围内, 则在 mapx 与 mapy 中相应的像素坐标位置记录“不存在”。

最终得到单次转换像素查找表 mapx 与 mapy 后, 将图像 A 变换到图像 B 可通过查表直接完成。

2.2 像素查找表的合并

在连续转换过程中,当鱼眼摄像头的安装固定时, 畸变校正和俯视变换时需要进行畸变矫正的转换规则在 安装后也是确定的。因此,可以将这两次转换的像素查 找表 (mapx1、mapy1 以及 mapx2、mapy2) 合并起来。 具体实现步骤如下 :

Step 1 :获取图像 mapx1 或 mapy1 的宽高分别 为 W1、H1.获取图像 mapx2 和 mapy2 的宽高分别为 W2、H2.

Step 2 :创建一个合并查找表 (mapx 与 mapy), 均为 W2 ×H2 的单通道图像。

Step 3 :遍历 mapx 或 mapy 中所有像素坐标 (i,j), 并查询该像素坐标 mapx2 的值 x2 与 mapy2 的值y2. 如果像素坐标 (i,j) 在图像 mapx1 或 mapy1 的范围内, 则将 mapx1 和 mapy1 中的像素坐标对应的值保存在 mapx 和 mapy 中的索引像素坐标处 ;否则,在 mapx 和 mapy 中的该像素坐标处记录“不存在”。

通过以上步骤的合并,实现将多个像素查找表合并 为一个,简化了多次变换的操作,统一为一次查找操作。

2.3 车载环视的查找表设计

将车载环视中的三步变换(畸变矫正、俯视变换、环 视融合) 合并为一步变换,能有效减少每一帧图像的计算量。在实现最终的环视效果图时,除了使用像素查找 表 mapx 和 mapy,还需要使用控制查找表 mapcontrol 与融合权重表 mapweight 作为辅助工具。像素查找表 记录环视图的像素点来源 ;控制查找表记录了像素点在 各组像素查找表中的查找位置 ;融合权重表记录了拼接 区域的像素融合权重值。其中,像素查找表 mapx 和 mapy 需要用到四组(每个摄像头对应一组),控制查 找表 mapcontrol 和融合权重表 mapweight 各需使用 一组。

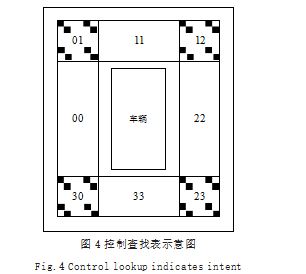

控制查找表 mapcontrol 如图 4 所示,将图像的四个 方位(左、前、右、后)分别定义为“0”“1”“2”“3”, 那么可以用“00”“01”“11”“12”“22”“23”“33”“30” 描述除中间区域外的 8 个区域。那么,环视图可根据相 应像素坐标的控制查找表的值,明确需要查找对应视图 的像素查找表,实现控制查找。

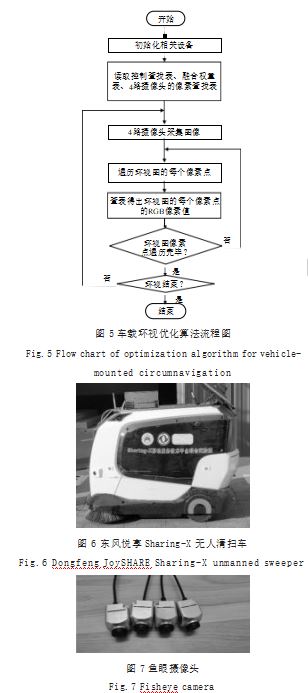

在车辆摄像头安装位置固定后,首次环视运行前需 要进行相机标定与环视区域划分,求出相应的像素查找 表、控制查找表与融合权重表。此后车辆运行中的环视 图像素值均可快速查表得出。车辆运行时环视融合流程 如图 5 所示。

3 实车验证与结果分析

为验证优化效果,设计了 3 组在不同车载嵌入式平 台的实车试验。分别采用 NXP i.MX8 Quad MAX(简 称 NXP i.MX8 QM)、Xavier AGX、Xavier NX 三 种 车载硬件嵌入式设备。车辆选用如图 6 所示的东风悦享 Sharing-X 无人清扫车,车上装有 4 个如图 7 所示的鱼 眼摄像头,摄像头采集分辨率为 1280×720.帧率为 30 帧,摄像头直接连接嵌入式设备进行图像处理。

在安装好摄像头后采用张正友标定法 [11] 对 4 路鱼 眼摄像头进行标定,得到 4 路摄像头的内参矩阵与畸变系数中各参数如表 1 所示。

根据图 2 划分车辆环视区域, 摆放标志物作环视标 定,摆放的实际尺寸如表 2 所示。划分出的环视实际尺 寸为 695cm×734cm。为便于计算,环视图像的像素 分辨率同样取 695×734.

通过公式 (6) 计算出每个视图都可得到俯视变换的 单应性矩阵,计算得到参数如表 3 所示。

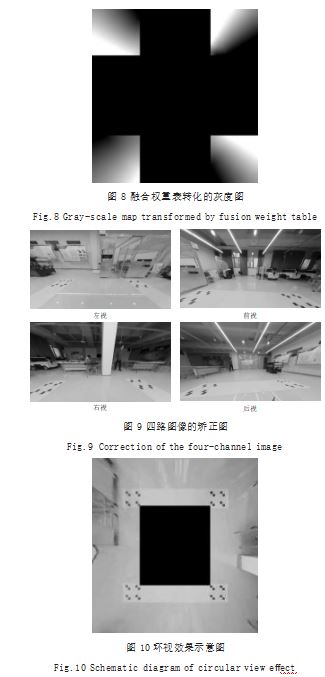

对重叠区域进行如式 (7)、式 (8) 所示的融合,得 到 4 角的融合权重,从而得到融合权重表 mapweight。 由于各像素权重值是 0 ~ 1 之间的浮点型,将其扩大为 0 ~ 255 的整型可表达为一张灰度图,如图 8 所示。

根据表 1 和表 3 的已知参数,结合式式 (1) ~式 (6), 以及结合单次转换像素查找表的建立与像素查找表的合 并步骤,可建立前、后、左、右每路视图的像素查找表 mapx 与 mapy, 且由于控制权重表 mapcontrol 已按 如图 4 所示给出,因此,环视的数据准备完毕。根据该 组数据以及摄像头采集的图像,可得到最终环视图。4路矫正图(包括左视、前视、右视与后视)如图 9 所 示,环视效果如图 10 所示。

考虑到偶然性,各嵌入式设备在初始化读取准备数 据后,分别进行了 10000 次延时测试,对比了加入环视 查找优化算法与没加环视查找优化算法的每帧环视图像 的处理时间。对比结果如表 4 所示。表 4 中处理时间是 通过程序打印的时间差值,精度是微秒级,表示从采集 完 4 路原始图像到计算出环视图像所消耗的实际时间。

从表 4 可以得出结论, 优化算法大大减少了环视图 每帧的处理时间,平均每帧处理的时间可缩短二分之 一以上。这使得环视图像处理在嵌入式 CPU 直接处理 更为流畅,而且优化后的像素查表架构,环视图中每个 像素点的像素值是独立计算的,更容易实现多核并行处 理,尤其是嵌入式 GPU 的并行计算,能更进一步的优 化环视时间。

4 结论

基于车载环视在嵌入式平台的实时性要求,本文设 计了一种车载环视方法,并通过多种查找表的方式,将 图像的畸变矫正、俯视变换、环视融合步骤进行了算法 简化,同时在车载嵌入式平台上进行了实车测试。具体 工作内容与结果如下 :

(1)基于环视的需求确立了环视步骤,环视步骤分 为畸变矫正、俯视变换、环视融合,设计了整体的环视 算法,最终完成了环视图的生成 ;

(2)提出了车辆环视图的查找方法,建立查找与融 合规则,使每一帧环视图像中的每个像素点 RGB 值都 可通过这种关系在原图查找到对应像素点或对应计算方 法,极大地省略掉中间步骤,达到简化程序步骤与优化 时间的效果 ;

(3)进行了两种车载嵌入式平台的实车试验,对比 了优化前后的结果,结果表明,在车载环视过程中该优 化方法能更快更为高效地生成环视图像。

参考文献

[1] 任学军.探索视野盲区对驾驶员安全驾驶的影响[J].科技风, 2020(30):193-194.

[2] KATO K,SUZUKI M,FUJITA Y,et al.Image Synthesis Display Method and Apparatus for Vehicle Camera:US,U S20020128079[P].2002-12-26.

[3] SU C L,LEE C J,LI M S,et al.3D AVM System for Automotive Applications[C]//International Conference on Information.IEEE,2016.

[4] 刘庆豪.工程车辆全景环视影像系统的研究[D].徐州:中国矿 业大学,2017.

[5] 高帆.车载全景环视系统的算法研究与实现[D].北京:华北电 力大学,2018.

[6] 栾婧.基于鱼眼摄像头的汽车环视技术研究[D].吉林:吉林大 学,2018.

[7] 何惠洋,韩军.基于SIFT算法的图像拼接技术研究[J].自动化 与仪表,2020.35(2):57-60+79.

[8] AL-HAMI M,CASAS R,SALHI S E,et al.Real-Time Bird's Eye Surround View System:An Embedded Perspective[J]. Applied Artificial Intelligence,2021.35(10):765-781.

[9] 李伟,曹立波,刘金源,等.针对铰接工程车辆的变角度全景环 视系统研究[J].中国公路学报,2021.34(5):194-203.

[10] LIANG Z W,CHEN L,AN F W.3D Vehicle Surround View Algorithm for Embedded Platform[C]//2022.

[11] ZHANG Z.Flexible Camera Calibration by V-iewing a Plane from Unknown Orientations[C]//Seventh IEEE International Conference on Computer Vision.IEEE, 1999.

[12] WU J,WANG L R,HUANG M Y,et al.High Precision Calibration of Fisheye Camera with Single Image under Multiple Geometric Constraints[J].Acta Optica Sinica,2018.38(11):1115001

[13] 宓桃,安平,刘苏醒,等.基于多视定位算法的多摄像机标定 [J].中国图象图形学报,2008.13(10):1922-1925.

[14] GONZALEZ R C,WOODS R E.Digital Image Processing[J]. IEEE Transactions on Acoustics Speech and Signal Processing,1980.28(4):484-486.

[15] 张言.像素级图像融合方法研究[D].吉林:吉林大学,2019. [16] 罗永涛,王艳,张红民.结合最佳缝合线和改进渐入渐出法 的图像拼接算法[J].红外技术,2018.40(4):382-387.

[17] 张兴超,陈贤富.基于LUT的多目机场视频实时拼接算法设 计与实现[J].信息技术与网络安全,2021.40(12):40-44.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/74019.html