SCI论文(www.lunwensci.com):

摘 要:深度学习算法,已经迅速成为多个应用领域,特别是在图像分析领域中,其已经成为一种主流研究方法。文中讲 述在图像分析领域有关深度学习应用的诸多方法,概述其在图像分析领域的主要算法。在文章最后,总结了深度学习在目前图 像分析方面的主要先进技术,并对未来可能的研究方向和问题进行了讨论。

关键词:深度学习 ;神经网络 ;图像分析

Survey of Image Analysis Algorithms Based on Deep Learning Model

HU Xiaojun, GUO Yiming

(Shandong University of Traditional Chinese Medicine, Jinan Shandong 250355)

【Abstract】: Deep learning algorithm has rapidly become the preferred method in many application fields, especially in the field of image analysis. In this paper, many methods of deep learning application in the field of image analysis are described, and the main algorithms in the field of image analysis are summarized. Finally, the main advanced technologies of deep learning algorithm in the field of image analysis are summarized, and the possible research directions and problems in the future are discussed.

【Key words】: deep learning;neural network;image analysis

0 引言

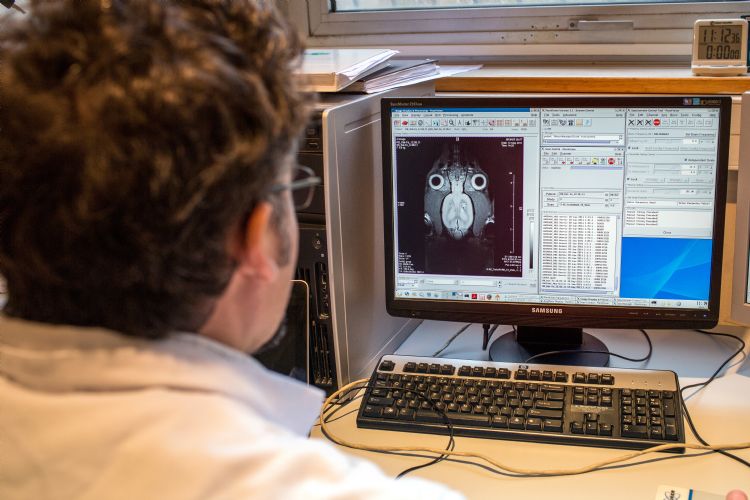

随着人工智能技术的广泛应用,在图像分析领域,迄今为止最成功的分析模型就是卷积神经网络 [1](CNNs)。 在 1998 年 LeCun 等人使用 LeNet 实现了手写数字识 别,这也是在实际应用中 CNNs 的第一个成功应用。尽管有这些初步的成功,但 CNNs 的使用在之后并没有产 生较快的发展,其一直到各种新技术被发展出来,可以 有效地训练更加深层次的网络后,才促进了其计算能力 的巨大进步 [2]。在 2012 年 Krizhevsky 等人使用分水 岭算法对 ImageNet 数据集进行了测试,其使用了名为 AlexNet 的深度学习算法在这次测试中展现了深度学习的巨大优势。本次综述的主要目的是,通过概述近年来深度学习在图像分析领域的发展,表明深度学习技术在该领域的使用情况,并突出部分应用中遇到的问题。

该综述的其余部分结构如下 :在第二部分中,将介绍用于图像分析领域的主要深度学习方法,第三部分中,将讨论在不同的应用领域中获得的结果和问题,最 后进行了总结,并展望了对未来的研究方向。

1 深度学习方法概述

本节将跟随深度学习近些年的发展,介绍其在当前 图像分析研究中应用到的主要概念、技术和架构。

1.1 学习算法

机器学习方法一般会被分为两大类,主要有有监督 学习算法,以及无监督学习算法。在监督学习算法中, 将由输入标签 y 和特征 x 组成的数据集 作 为输入数据,其中又可以根据任务的不同,有很多不同 的形式来实现。在分类工作中,y 一般作为分类标签的 标量,而在回归任务下,又可以是连续变化的值。监督训练通常是寻找模型参数 θ,使其能够对基于损失函数 L(y, ) 的输入数据得到最准确地预测数据。其中表示 的是将一个数据 x 输入函数 f(x;θ) 中得到的输出。

另外,无监督学习主要是用于没有标签的数据处理,通过不断的训练来发现学习模型。传统的无监督学 习又主要分为聚类方法,以及主成分分析方法,无监督 方式可以应用于多种不同的损失评估下执行。

1.2 神经网络

大多数深度学习方法都是由神经网络作为基础算法 构成的。一个神经网络主要由一些包含激活函数 a 和参 数 θ={W,B} 的神经元组成,其中 B 是偏置集合,W 是 权值集合。激活函数是神经元的输入 x 以及相关参数的线性组合,然后再被用于非线性函数 σ 转换 :

a=σ(W

Tx+b) (1)

传统的神经网络常用的转换函数是 sigmoid 函数或双曲正切函数。多层感知器(MLPs)是最为人熟知 的传统神经网络,它具有以下几层变换 :

f(x;Θ)=σ(W

Lσ(W

L-1 ……σ(W

0x+b

0)+b

L-1)+b

L) (2)

这里的 W

n 是由 W

k 行组成的计算矩阵,并且与输 出激活 k 相关联。n 是当前层的编号,L 是最后一层。 “隐藏”层由输入和输出之间的计算部分组成。当神经 网络中有多个隐藏层时就被认为这是一个“深度”的神 经网络,即“深度学习”。

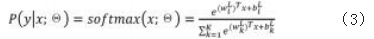

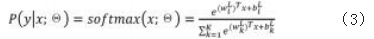

网络计算的最后一层将计算结果通过 softmax 函 数转变成关于类别 P(y|x;Θ) 的分布 :

其中 W其中 W

i 表示与第 i 类输出节点相关联的权重矩阵。

为了在输入数据集 D 下得到最合适的学习参数 Θ, 随机梯度下降法成了目前最受欢迎的方法。随机梯度下 降使用的是全部数据的一个数据子集 mini-batch 来做 计算,用于每次梯度的更新,而不是用完整的数据集来 计算梯度实现参数的最大优化 :

表示与第 i 类输出节点相关联的权重矩阵。

为了在输入数据集 D 下得到最合适的学习参数 Θ, 随机梯度下降法成了目前最受欢迎的方法。随机梯度下 降使用的是全部数据的一个数据子集 mini-batch 来做 计算,用于每次梯度的更新,而不是用完整的数据集来 计算梯度实现参数的最大优化 :

以上是二分类,以及多分类任务的交叉熵损失计 算。这种方法的缺点就是一般很难优化得到我们所关心 的全局最优解部分。

目前,最流行的结构就是卷积神经网络(CNNs) 和循环神经网络(RNNs)。CNNs 目前在图像分析中的 应用最为广泛,但 RNNs 也正日益普及。以下各节将简 要概述每种方法,并讨论它们在目前应用中的差异和潜 在问题。

1.3 卷积神经网络(CNNs)

后来出现的 CNNs 和 MLPs 之间存在着两个主要 的不同之处,CNNs 中是通过共享权重来对图像执行卷 积运算,不需要对一张图片中出现在不同位置的同一物 体训练不同的检测器,从而使得数据的转换是等价的,同时,学习所需要的参数个数大大减少了,即输入图像 的大小不决定权重的数量。

在每一个计算层中,输入数据都会被一系列有着 K 个 W={W

1,W

2 …… W

K} 以及偏 差 B={b

1,b

2 …… b

K} 的卷 积核做计算,每个都会产生一个输出特征 X

k,同时,这 些结果还会受到非线性变换 σ 的影响。然后每个卷积层 l 需要做出相同的计算过程 :

CNNs 和 MLPs 之间的第二个不同是,CNNs 中一 般会存在有池化层,其中邻域的像素值通常会使用最大 池化或平均池化来做聚合,这可以产生一定的转换稳定 性,并使得后续卷积层的感受野得到增加。在进行卷积 计算之后,一般会添加全连接计算层,这时候的权重不 再会被共享。与 MLPs 类似的是, softmax 函数会将最 后一层通过激活函数反馈给网络,从而生成所属类别上 的分布,同时网络通过其中获得的最大的类别可能性进 行训练和学习。

1.4 深度学习

鉴于 CNNs 在图像分析中的广泛应用,本小结阐述 了其中最常见的体系结构和模型,以及它们之间存在的不同差异。

1.4.1 图像分类

LeNet 和 AlexNet 两种网络的出现相差了大概有 十多年,但它们却是特别相似的算法。两者相对来都说 比较简单,分别由两个和五个卷积层组成,感受野较大 的核在比较靠近输入层的一侧,感受野较小的核在比较 接近输出层的一侧。

2012 年之后,尤其是最近这些年,人们越来越倾 向于构建更深层的网络。通过层叠使用多个比较小的计 算核,来替换之前使用具有比较大的感受野的核进行卷 积,同时,可以减少相关计算参数的使用。在计算过程 中,这些更深层的模型一般会占用比较低的内存使用, 进而能够运行在移动设备上。Simonyan 和 Zisserman 是较早探索深层网络的人,他们在计算中的每一层应用 了尺度一样的小内核,之后产生了 19 层的 VGG19 模 型赢得了 2014 年的 ImageNet 图像识别竞赛。

自 2014 年以来,在 ImageNet 图像识别基准测试上的性能基本已经到达最高水准,之后得到的结果很难 评估其测试性能的小幅提升是否真的是由于采用了更好 和更复杂的算法结构导致的。

1.4.2 图像分割

图像分割是自然图像分析中的一项常见任务,为了 解决这一问题,CNNs 可以通过在特定像素周围进行插值来简单地将图像中的每个像素进行单独分类。但这 种方法存在一个缺点 :来自相邻像素的输入有大量的重 叠,并且相同的卷积需要计算多次。但是,卷积和点积 都是线性运算,因此内积可以写成卷积的形式,反之亦 然。通过将全连接层重写为卷积,CNN 可以获取比训 练图像更大的输入图像数据,并输出相关的映射,而不 是单个像素的输出。由此产生的完全卷积网络(fCNN) 可以有效地应用于整个输入图像 [3]。

Ronneberger 将 fCNN 的想法更进一步, 并提出 了 U-net 架构。这不是第一篇在卷积神经网络中引入上 采样路径的论文,但作者将其与跳跃连接结合起来,直 接连接了反向收缩和扩展卷积层。2016 年 Millenari 等人提出了 U-net 的扩展,该扩展包含了类似 ResNet 的残差块和 Dice loss 层,而不是传统的交叉熵损失, 直接最小化了这种常用的分割误差。

1.5 循环神经网络(RNNs)

通常,RNN 是为离散序列分析而开发的。它被看作 是 MLPs 的一个推广,因为输入和输出的长度都是可变 的,这使得其适用于机器翻译等任务,其中源语言和目 标语言的句子分别是输入和输出。在分类设置中,模型 学习的是给定序列 x

1,x

2,… ,x

T 在类 P{y|x

1,x

2,… ,x

T;Θ} 上的分布,而不是单个输入向量 x。

RNN 在时刻 t 有隐藏状态 h,该状态 h 来自其输 入 x

t 和先前状态 h

t-1 的非线性映射输出 :

公式中的权重 W 和 R 会随着时间而共享。在分类 问题任务中,一般会在最后添加一个全连接计算层,然后用 softmax 函数以将结果映射成类的分布。

由于梯度需要从输出沿时间反向传播,RNN 在时间上的层级也很深,因此与以往深度神经网络在训练方 面存在相同的问题。为此,目前已经开发了几种专门的 记忆单元,如 LSTM 单元,GRU 是最近对 LSTM 的简 化,相比 LSTM 来说计算开销较小,也是比较常用的。

尽管 RNN 最初是针对一维输入提出的,但它逐渐 开始应用于图像领域。2015 年其被用于图像分割问题, Stollenga 等人在 MRBrainS 挑战赛中取得了很好的结果。

2 结语

深度学习已经快速渗透到图像分析的各个方面,虽 然卷积神经网络现在是表现最好的,但未来还是期望能 够为每个单独的应用领域找出合适的方法。准确的算法 并不是获得好的解决方案中最重要的因素,一个经常被 忽视的关键问题是,任务的专业知识可以带来比单纯为 CNN 增加层数更大的优势,比如新的数据预处理或增 强技术。另一个提高性能的方面是模型的超参数优化, 但目前没有明确的方法可以得到最优解,目前大多数还 是使用随机搜索方法。还有数据类别不平衡问题,通常 异常类的图像可能不足,当前主要是通过数据增强来解 决类别失衡。未来,随着以后技术的发展,深度学习算 法预计会在将来的图像分析方面继续发挥重要作用。

参考文献

[1] 周晓彦,王珂,李凌燕.基于深度学习的目标检测算法综述[J]. 电子测量技术,2017,40(11):89-93.

[2] 杨观赐,杨静,李少波,等.基于Dopout与ADAM优化器的改 进CNN算法[J].华中科技大学学报(自然科学版),2018,46(7): 122-127.

[3] 伍伟明.基于Faster R-CNN的目标检测算法的研究[D].广 州:华南理工大学,2018.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/34317.html