SCI论文(www.lunwensci.com)

摘要 :根据使用场景及应用需求, 提出采用 X 角点构成视觉标签, 利用视觉标签标记场景中关键路径点的方式实现 AGV 的定位和 路径规划的视觉导航方法 。搭建双目立体相机, 基于段测试 X 角点检测算法, 识别视觉标签 、建立标签坐标系统, 根据视觉标签 库中的预存信息检索 、确定 AGV 的地图位置; 基于视觉标签局部坐标系统, 确定 AGV 的姿态信息, 在简化导航复杂度的同时, 保 证 AGV 路径控制和运行控制精度和可靠性, 进而实现基于视觉标签的自动导航和运动控制 。将双目立体相机应用于 AGV 现场试 验, 结果表明, 所搭建的双目立体相机能够为 AGV 的视觉导航提供信息, 开发的基于视觉标签的导航算法具有较好的鲁棒性, 视 觉标签的正确识别率达 95%, 双目立体相机定位误差小于 2%, 充分发挥了视觉导航的优势, 能够完成园区内的可靠自动运行。

关键词:立体相机,AGV,三维定位,图像处理

Research on Binocular Stereo Camera for AGV Navigation Wei jun1. Luan Jinyuan1. Hu Yan1. 2. Mu Qingsheng1

( 1. School of Electrical Engineering, University of Jinan, Jinan 250022. China;

2. Shandong Intelligent Robot Application Technology Research Institute , Jining, Shandong 273500. China)

Abstract: Based on application requirements and usage scenarios, a visual navigation method is proposed to use X corner to form visual

labels, and to use visual labels to mark key path points in the scene to achieve AGV positioning and path planning . Binocular stereo camera is

built, the X corner detection algorithm is tested based on segments, visual labels are then identified, and a label coordinate system is

established, based on the pre-stored information in the visual label library, the map position of AGV can be retrieved and determined . Based on

the visual label local coordinate system, the attitude information of AGV is determined, which simplifies the navigation complexity while

ensuring the accuracy and reliability of AGV path control and operation control , thereby achieving automatic navigation and motion control

based on visual labels. The binocular stereo camera is applied to AGV on-site for testing , and the results show that the constructed binocular

stereo camera can provide information for AGV visual navigation . The developed navigation algorithm based on visual labels is fairly robust , the

correct recognition rate of visual labels reaches 95%, and the positioning error of binocular stereo cameras is less than 2%, fully leveraging the

advantages of visual navigation, and achieving reliable automatic operation in the park with visual labels .

Key words: stereo camera; AGV; 3D positioning; image processing

引言:近年来, 随着人工智能和计算机视觉的快速发展, 双目立体相机的应用越来越广泛[ 1] 。 目前已广泛应用于 无人驾驶 、智能安防 、智能家居 、医疗影像等领域[2-5]。 将双目立体视觉应用于自动导引车辆 (Automated Guid⁃ ed Vehicle, AGV ) 导航更是成为相关领域研究的热点[6]。 美国普渡大学机器人视觉实验室成功研制出视觉导航 AGV—Peter[7] 。该 AGV 能够获取工作场景中运行环境与 障碍物信息, 结合多种测距传感器实现 AGV 的柔性行 驶 。 国防科技大学通过在车顶上安装 2 台摄像头作为环 境传感器实现提取道路特征和感知道路情况的功能, 根 据机器视觉处理算法的输出结果控制车速和改变车辆运 动方向, 成功开发出能自动行驶的无人驾驶汽车[8]。

视觉导航取得了发展但目前仍受双目相机硬件和相 关导航算法的限制[9] 。STEREOLABS 公司推出的 ZED 立 体相机计算得到的深度精确可靠, 但是对处理器有较高 要求且相关算法开发受到限制 。双目相机司眸 PSP010- 800 采用自主研发的 RSV-P3D 视觉技术, 为室外自主移 动机器人提供稳定实时的深度感知能力, 可用于障碍检 测和三维重建等, 但是其精度不是很理想[ 10]。

在地图已知的园区内导航, 可以在获知关键路径点 的前提下, 减少 AGV 的感知需求, 若可在关键点处精确 检测车体位姿, 就能够以较低的算力实现可靠的路径和 运动控制 。 目前市面上的双目相机厂商众多, 产品设计 原理和技术参数千差万别, 体积 、技术 、价格差距也很 大[ 11], 最重要的是应用者需要根据自身不同的应用需求和使用场景选择最适合的双目相机, 因此本文提出设计 一款面向 AGV 导航的双目立体相机, 满足应用现场的视 觉导航需要 。 同时针对市面上双目相机开发难度较大、 受算法限制等问题, 对搭建的双目立体相机进行相关功 能开发 。将相机应用于 AGV 上, 为 AGV 的视觉导航提供 信息, 充分发挥视觉导航的优势, 完成在设置视觉标签 的园区内的可靠自动运行。

1 双目相机设计方案

1 . 1 相机与镜头选型

结合应用特点, 综合考虑相机视场和检测精度, 相 机选型以图像分辨率 、帧率和传感器形式为主要内容[ 12]。

( 1 ) 分辨率拍摄的物体大小为 60 mm×60 mm; 要 求 的 检 测 精 度 为 2%, 即 1.2 mm; 拍 摄 的 视 野 范 围 在 1 800 mm × 1 350 mm, 那么相机的最低分辨率应该选择 在: ( 1 800/ 1.2 ) ×( 1 350/ 1.2 ) =1 500× 1 125. 约为 170 万 像素的相机, 决定选用 200 万像素。

( 2 ) 传 感 器 主 要 分 为 CCD 和 CMOS 两 种[ 13], 基 于 CMOS 的工业相机需要的部件较少, 电耗较低, 提供数 据的速度也比基于 CCD 的相机快; CCD 提供良好的图像 质量 、抗噪能力, 适合天文 、高清晰的医疗 X 光影像 、 以及其他需要长时间曝光 、对图像噪声要求比较严格的 应用场合[ 14] 。考虑处理图像的时效性及价格成本, 决定 选用 CMOS 工业相机。

机器视觉系统中, 镜头相当于人的眼睛, 其主要作 用是将目标的光学图像聚焦在相机的光敏面阵上[ 15] 。在 AGV 小车运动的过程中, 观测距离为 1~4 m, 对观测范 围的要求较高, 因此在选择镜头的过程中应选择短焦距 的广角镜头, 并根据实际观测范围计算镜头焦距。

镜头的焦距计算主要考虑 AGV 的运动速度和相机取 图的帧率 2 个因素, AGV 运动速度为 0. 1 m/s, 帧率大于 20 Hz 处理算法效果最好, 根据现场测试, 镜头在物距 为 1.5 m 时应至少看见 1 800 mm× 1 350 mm 的视野范围, 这样才能保证 2 个镜头能同时拍到视觉标签且在一定时 间范围内可以处理多组图像。

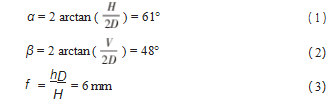

根据式 ( 1 ) ~ ( 2 ) 分别计算镜头水平视角 α 和垂直 视角 β 。然后根据已知的靶面尺寸 h 和 v 、工作距离 D、 视野范围 H 和 V, 按照式 ( 3 ) 计算镜头的焦距f。

1 .2 双目立体相机原理

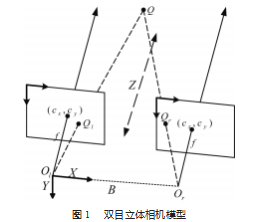

平行光轴双目相机具有匹配简单 、精度高 、三维重 建范围大等特点[ 16- 17], 利用目标点被两个平行放置的相机拍摄所成的二维图像, 由目标点在 2 张图像所成点的 像差, 根据相似三角形原理来获取目标点在以左相机光 心为坐标原点的三维坐标 。双目立体相机模型如图 1 所示。在设计双目立体相机的过程中, 考虑到相机基线 (两个摄像头间距) 会影响测量范围, 在两个相机下方安 装了可调基线的支架板, 基线越小, 共同成像点越近, 测量范围越小, 基线越大, 共同成像点越远, 测量范围 越大[ 18] 。考虑到拍摄的视觉标签距离为 1~4 m, 已知镜 头的视场角, 保留30% 裕度, 根据式 (4) 计算基线范围。

B = 2d tanα/2 (4)

式中: B 为基线长度; d 为目标点在相机Z 轴下的距离。

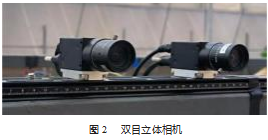

根据计算结果, 要想在最近 0.7 m 处看到共同成像, 基线距离为 116 mm, 考虑到远处成像的清晰度, 取基线 长度为 120 mm 对相机进行固定, 并完成对双目相机的搭 建, 如图 2 所示。

1 .3 相机标定

本文的研究对象为室内视觉导航 AGV, 相机工作环 境变化较小, 在一定工作周期内相机的参数矩阵可假定 为不变, 考虑到自标定法鲁棒性较差, 影响标定精度、 基于主动视觉的相机标定法成本较高且适用环境有限[ 19], 本文采用张正友标定方法[20]对相机进行标定。

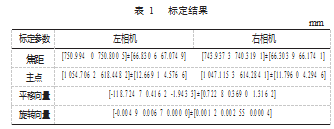

采用角点数量为 11× 8 的棋盘格进行标定, 棋盘单元 格尺寸为 25 mm, 在采集相机标定输入照片的过程中, 为提高相机标定的精度, 保证所采集照片的视角互不相 同, 标定结果表 1 所示。

2 基于视觉标签的导航算法

视觉定位的标签是一种能够被机器人所识别的视觉 基准, 它能够提供机器人导航所需的位置和导航信息[21]。 本文首先参考 X角点的图像特征设计了包含位置信息和 方向信息的视觉标签 。采用段测试法检测 X角点和定位, 设计角点匹配算法实现对视觉标签的提取, 通过对视觉 标签的特征分析编写了标签识别算法, 并通过坐标系的 转化实现 AGV 位姿的检测。

2 . 1 视觉标签设计

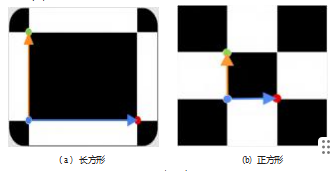

本文选用矩形作为视觉标签的形状属性 。棋盘格的 边缘轮廓明显且规律, 对棋盘格的角点提取并建立几何 关系, 利用棋盘格规则性设计几何形状, 设计的视觉标 签如图 3 所示。

主要设计了长方形和正方形视觉标签, 由于标签之 间不具有唯一性特征, 根据角点数判断标签类别会出现 “标签混淆”现象[22], 因此需要增加标签的特征, 在角点 个数的基础上规定了不同视觉标签角点间的截线段长度, 提高了对标签识别的可靠性。

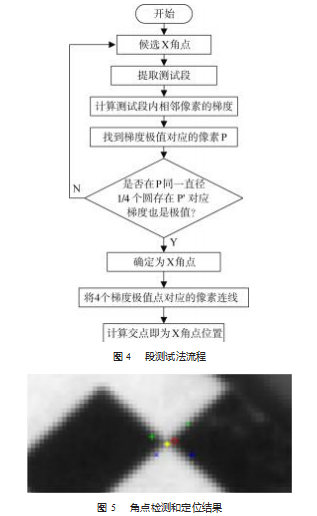

2 .2 X 角点检测

X 角点位于亮暗图块的公共点, 即图像边缘的交点 上[23], 首先依据组成角点的任一图块所占面积应小于窗 口面积一半, 进行面积筛选, 排除绝大部分背景区域; 然后根据 X角点成像的对称性对所得图像进行对称筛选 得到检测图像中的候选 X角点 。若需要精确定位, 可进 行 X角点的段测试亚像素定位具体流程如图 4 所示。

图 5 所示为实验图像的候选 X角点进行段测试及亚 像素定位的结果, 其中 “×”标记了梯度极大值位置 , “+”标记了梯度极小值位置,“O”为候选 X角点,“*” 为亚像素定位结果。

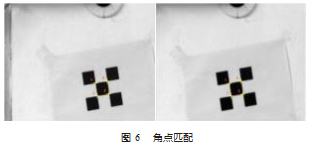

2 .3 X 角点匹配

角点匹配是指寻找 2 幅图像之间的特征像素点的对 应关系, 从而确定 2 幅图像的位置关系[24] 。如图 6 所示, 角点匹配的过程就是将对两幅图像中的对应 X 角点坐标 进行配对的过程。

为了提高匹配算法的效率, 制定了从左往右 、从上 往下的匹配策略 。因为视角和坐标系的原因, 左右相机 同时拍到某个 X角点的时候, X 角点在左图中的 U 坐标 往往是要大于其在右图中的 U 坐标的, 这与 UV 坐标系的 原点制定在图像的左上角有关, 通过左右约束的限制, 我们可以提高角点匹配的效果。

极线约束是同一个点在两幅图像上的成像坐标的约束 。已知某物的左图映像点 P1. 那么其在右图的映像 P2 一定在相对于 P1 的极线上, 极线约束将对应问题减少到 沿着极线的一维搜索, 这样可以减少待匹配的点数量从 而提高匹配的效率[25] 。根据平行光轴双目相机的极线约 束, 左右图像的对应角点在 UV 坐标对中的 V 坐标基本一 致, 由于设备的机械加工和检测效果的影响, 允许偏差 约 2个像素。

2.4 视觉标签的识别及其坐标系统

标签的检测和识别流程主要分为角点检测和匹配 、 标签坐标系的建立 、角度和长度核验 3个部分 。各部分 具体作用如下。

( 1) X 角点检测和匹配 X 角点的快速筛选和定位是 一切工作的前提和基础, X 角点的定位精度决定了整个 导航系统的精度, 而角点匹配算法则决定了标签识别算 法的效率和可靠性。

( 2) 标签坐标系的建立得到正确的坐标对后, 采用 前文所提到的双目立体视觉模型进行计算, 将二维像素 坐标转化为三维坐标, 按 X轴在图像中向右 、Y轴在图 像中向上 、Z轴垂直于 X轴和 Y轴所在平面定义标签的 坐标系。

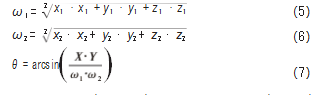

( 3) 角度和长度核验利用得到的角点三维坐标构建

2 个三维向量 X(x 1 ,y 1 ,z 1) 和 Y(x2 ,y2 ,z2), 并通过式 ( 5) 和式 ( 6) 计算 2个向量长度, 通过式 ( 7) 计算夹角度 数 θ。

式中: ω 1 为向量 X (x 1 ,y 1 ,z 1) 的模; ω 2 为向量 Y (x2 ,y2 ,z2)的模。

在得到待识别视觉标签的有关几何信息后, 在预先 注册的标签库中, 检索符合视觉标签长度 、边 (轴) 夹 角的标签, 确定该标签的标识, 并读取标签对应的地图 信息; 同时, 利用标签中的 X角点建立视觉标签的局部 三维坐标系, 确定 AGV相对视觉标签的精确位姿, 用于 AGV 的车体姿态控制 、路径控制等。

3 现场测试

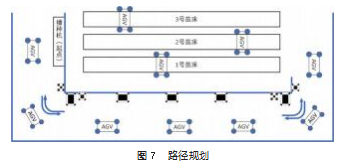

将本文设计的双目立体相机及配套算法搭载在一台 四驱四转的电动小车上, 在设施农场进行了应用测试 。 工作现场道路和路径规划如图 7所示。

AGV 的起点在播种机处, 由工人装满货物后, AGV 开始直行, 向南运行一段距离后到达西门拐弯处 。当相 机拍到并识别出转弯的 A3030视觉标签会发出转弯的命 令 。转弯的过程中, 相机会不断拍摄并检测方向标签,

当其识别到方向标签时会计算 AGV 车体与方向标签的 间距, 同时核查车体的方向角, 重复检查确认处于安全 角度即当车体与视觉标签几乎平行时, AGV停止转弯并 重新开始直行 。直行的过程中双目相机会不断拍到方向 标签并核验间距和方向角, 一旦车辆走偏会发出左转或 者右转命令进行校正, 确保 AGV 自主走到东门转弯处。

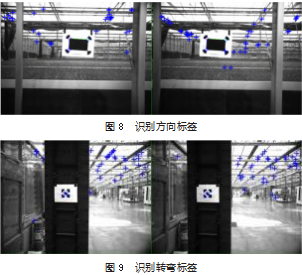

在东门同样贴着与西门相同的视觉标签, 相机识别到转弯标签后发出转弯命令, 并再次与方向标签进行核 验以重新发出直行的命令, 最后将货物运达指定苗床后。 在现场对视觉标签的识别如图 8~9所示, 经现场验证, 相机对所设计的视觉标签的正确识别率达 95% 以 上, 所设计的双目立体相机定位误差在 2% 左右, 满足 视觉导航的需要, 所设计的视觉导航算法为 AGV 的自主 导航提供了可靠信息 。 由于设施农场中光线变化剧烈, 背景复杂, 测试中还存在成像寻优以便减少干扰角点数 量及适应光线变化等问题需后续研究进一步优化。

4 结束语

本文提出采用视觉标签, 建立低成本 AGV用于园区 运输的视觉导航方案, 并进行了现场验证 。实验结果表 明, 所搭建的双目立体相机可以长时间稳定工作且提供 高质量图像, 同时开发的基于视觉标签的导航算法具有 较好的鲁棒性, 可以同时提供位置和方向信息, 应用价 值更高 。但在实际现场中, 因为道路情况多变且工业现场杂物较多, 会检测出很多意外的角点并因此可能产生 误匹配的现象, 同时影响了标签识别算法的时效性, 下 一步要对角点检测的算法进行升级, 提高 X角点检测算 法的可靠性与稳定性, 为下一步深入研究奠定基础。

参考文献:

[ 1] 刘劭纯 . 自动导引运输车发展现状及关键技术分析[J]. 无人系 统技术,2020.3(3): 19-24.

[2] 赵楠 . 双目立体视觉系统的研究与应用[J]. 电子技术与软件工 程,2021. 199(5): 118- 119.

[3] 宋春华, 彭泫知 . 机器视觉研究与发展综述[J]. 装备制造技术, 2019.294(6):213-216.

[4] 莫冬炎,杨尘宇,黄沛琛,等 . 基于环境感知的果园机器人自主 导航技术研究进展[J]. 机电工程技术,2021.50(9): 145- 150.

[5] 刘雪兰 , 田宏伟 . 农业自动引导车的路径模糊控制技术研究 [J]. 机电工程技术,2021.50( 12): 139- 142.

[6] 李斌,刘明兴,姚明杰,等 . 基于视觉导航 AGV 的定位算法及系 统设计[J]. 青岛大学学报(自然科学版),2022.35(2):83-91.

[7] 陈显宝, 金隼, 罗磊,等 . 基于视觉定位的 AGV 定位精度提高 方法[J]. 机械设计与研究, 2021. 37( 1): 36-40.

[8] 喻俊, 楼佩煌, 钱晓明,等 . 自动导引车视觉导引路径的识别及 精确测量[J]. 华南理工大学学报(自然科学版), 2012. 40(3):143- 149.

[9] DU Hailong, HU Lei, HAO Ming, et al. Application of binocular visual navigation technique in diaphyseal fracture reduction[J]. The International Journal of Medical Robotics + Computer As ⁃ sisted Surgery: MRCAS,2020. 16(3): e2082.

[ 10] 黄鹏程, 江剑宇,杨波 . 双目立体视觉的研究现状及进展[J]. 光 学仪器,2018.40(4):81-86.

[ 11] 李富康 . 基于双目立体视觉的移动机器人避障方法研究[D]. 西安:长安大学,2021.

[ 12] 吴文麟,廖晓波,李俊忠,等 . 工业相机过曝光自适应优化控制 算法[J]. 光学精密工程,2023.31(2):226-233.

[ 13] 马精格 . CCD 与 CMOS 图像传感器的现状及发展趋势[J]. 电子技术与软件工程,2017( 13): 103.

[ 14] NASA. Image comparison from CCD and CMOS cameras[J]. NASA Tech Briefs,2014.38(7):53.

[ 15] 张欣婷, 亢磊,丁红昌,等 . 基于机器视觉的非球面双远心工业 镜头设计[J]. 激光与红外,2019.49(2):230-234.

[ 16] 郑岩 . 基于双目立体视觉的机械臂运动位置测量[D]. 武汉 : 华中科技大学,2021.

[ 17] 颜远辉,夏海英 . 三维重建中的摄像机标定研究[J]. 广西物理, 2014.35( 1):21-25.

[ 18] 徐俊星 . 基于双目视觉的测距系统研究及其实现[D]. 重庆 : 重庆邮电大学,2021.

[ 19] 黄文文, 彭小红,李丽圆,等 . 相机标定方法及进展研究综述[J/ OL]. 激光与光电子学进展 : 1- 17[2023-02-21].http://kns.cnki. net/kcms/detail/31. 1690.TN.20221031. 1625.096.html

[20] 景国峰 . 基于计算机视觉的相机标定方法[J]. 北京测绘,2021. 35( 1): 122- 125.

[21] HOCKING T D, GOERNER-POTVIN P, MORIN A, et al. Opti⁃ mizing ChIP-seq peak detectors using visual labels and super⁃ vised machine learning[J].Bioinformatics,2017.33(4):491-499.

[22] 杨娜 . 基于双目视觉的室内服务机器人导航技术研究[D]. 西 安: 西安航天精密机电研究所,2016.

[23] 魏军,刘达,王田苗,等 . 基于段测试的 X 角点检测与亚像素定 位[J]. 机器人,2011.33( 1):97- 101.

[24] 李浩,秦姣华, 向旭宇,等 . 结合自适应阈值与 Forstner 的Harris 角点匹配优化算法[J]. 电讯技术,2018.58(9): 1079- 1085.

[25] 任继昌,杨晓东 . 极线约束条件下的双目视觉点匹配策略研 究[J]. 舰船科学技术,2016.38(3): 121- 124.

作者简介:

魏 军 ( 1974- ), 男, 江苏常州人, 博士, 副教授, 研究领域 为机器人技术 、检测技术与智能装备。

胡 岩 ( 1979- ), 男, 博士, 济南市市中区客座教授, 高级工 程师, 研究领域为智能机器人 、虚拟/增强现实 、先进传感器、 医疗图像处理, 已发表论文近 40 篇。

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/ligonglunwen/64264.html