SCI论文(www.lunwensci.com):

摘 要 :为了解决目前雾天图像的模糊问题, 本文提出了一个轻量的单幅图像去雾计算模型。本文基于 AOD-Net 的基本 架构,利用动态卷积替代普通卷积来搭建轻量级的卷积神经网络,在不增加网络深度的情况下增加网络的特征表示能力,从而 提高网络精度。然后,引入 ECA 注意力模块,有效地捕获了跨通道交互,并且避免了维度的缩减,从而提高了网络模型获取 雾图信息的能力。同时,改进 AOD-Net 的损失函数为 MS-SSIM-L2 复合损失函数来优化去雾图像的亮度、颜色和对比度。最 后,本文分别使用 NYU2 和 RESIDE 数据集来训练和测试我们提出的网络模型。实验结果表明,本文采用的算法对比原来的 算法在各项数值上均有提升,证明了此算法的有效性。

关键词 :图像去雾 ;动态卷积 ;注意力机制 ;损失函数

Research on an Improved AOD-Net Defogging Algorithm Based on Deep Learning

ZHOU Qi1, WANG Keqing2, JIAO Sitao1, LI Liuyang1

(1.School of Automation, Nanjing University of Information Science and Technology, Nanjing Jiangsu 211800;2.School of Automation,Wuxi University, Wuxi Jiangsu 214000)

【Abstract】:In order to solve the blurring problem of foggy images, a lightweight single image dehazing computational model is proposed in this paper. Based on the basic architecture of AOD-Net that uses dynamic convolution to replace the original convolution to build a lightweight convolutional neural network, which increases the feature representation ability of the network without increasing the depth of the network, thereby improving the accuracy of the network. Then, the ECA attention module is introduced to effectively capture the cross-channel interaction and avoid the dimension reduction, so as to improve the ability of the network model to obtain the information of the fog map. At the same time, the loss function of AOD-Net is improved to MS-SSIM-L2 composite loss function to optimize the brightness, color and contrast of the dehazed image. Finally, NYU2 and RESIDE datasets are used to train and test our proposed network model, respectively. The experimental results show that the algorithm used in this paper has improved in all values compared with the original algorithm, which proves the effectiveness of this algorithm.

【Key words】:image dehazing; dynamic convolution; attention mechanism; loss function

0 引言

随着计算机视觉和图像处理领域的迅速发展,图像 质量的提升一直是研究人员关注的焦点之一。然而,在 实际应用中,由于大气散射、雾霾等环境因素的影响, 采集的图像往往受到严重的退化,导致细节丢失、对比 度降低等问题。图像去雾 [1] 作为一项关键技术,旨在从 受雾影响的图像中恢复真实场景信息,对于改善视觉感知和自动分析具有重要的意义。目前,图像去雾算法主 要分为两类。

(1)基于物理先验的去雾方法。基于物理先验的方法 取决于物理散射模型 [2-4]。一些方法将经验观察作为先验 知识来恢复模糊图像,例如,暗通道先验 (Dark Channel Prior, DCP)[5]、颜色衰减先验(Color Attenuation Prior, CAP) [6] 和非局部先验 [7]。He 等人提出了一种根据像素强度的干净户外图像的暗通道先验(DCP)方法,通 过这种方法实现了良好的去雾性能。Zhu 等人发现模糊 图像中像素的亮度和饱和度是不同的,提出颜色衰减先 验(CAP)的去雾算法。Berman 等人观察到在给定的 RGB 空间当中,像素通常都是非局限的,提出了一种 有效的非局部先验算法。虽然这些先验算法在一些场景 当中都取得了不错的去雾效果,但在真实世界当中,各 种复杂的因素都能影响到雾的状态,导致这些先验算法 无法取得较好的去雾效果。例如,暗通道先验(DCP) 就无法对天空区域进行有效的去雾。

(2)基于深度学习的去雾算法。近些年,随着深度 学习的快速发展,已经在去雾领域中提出了许多的基于 深度学习的去雾算法。Cai 等人 [8] 提出了一种端到端去 雾网络(DehazeNet),通过大气散射模型恢复无雾的 清晰图像。Li 等人 [9] 提出了一种一体化去雾网络(ALL- in-One Network,AOD-Net), 通过联合估计大气光 和散射率的参数,从而得到清晰的去雾图像。虽然相比 于传统的去雾算法,深度学习的去雾算法取得了更好的 效果,但是仍然存在着一些不足之处。

本文提出了一种基于 AOD-Net 改进的去雾算法, 在不影响去雾速度的情况下,提升了网络整体的去雾 效果。利用动态卷积 (Dynamic Convolution)[10] 代替 AOD-Net 网络中的标准卷积,提高网络的表征能力。 在特征增强部分引入 ECA 注意力模块 [11],避免了维度 缩减,有效地完成信息在跨通道之间的交互,并且改进 了损失函数,优化去雾的图像质量,最终实现图像的去 雾操作。

1 基本原理

1.1 大气散射模型

大气散射模型 [12,13] 是用于描述光在大气层中传播 时,由于散射现象而产生效应的一种数学模型。这种散 射效应会导致光的传播方向发生改变,以及光的颜色和 强度发生变化。其数学模型如式(1)所示 :

其中, I(x) 为有雾图像, J(x) 为去雾后的图像, A 为全局大气光, t(x) 表示场景透射率。此外, t(x) 的定 义如式(2)所示 :

其中,

β 是大气散射系数,

γ 表示反射光的波长,

d(

x) 是场景的深度,就是场景当中的物体成像时与设备 的距离。

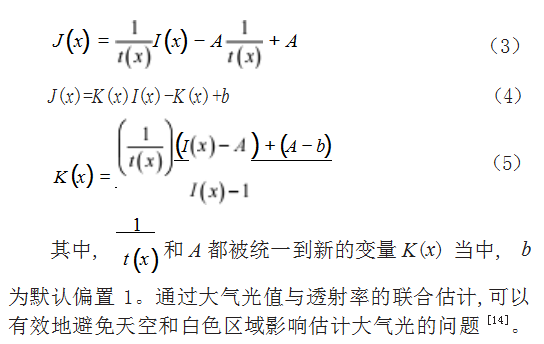

1.2 变形的大气散射模型公式

由于单独估计

t(

x) 和

A 的值来恢复出干净图像

J(

x), 会导致误差的累计和放大。所以将

t(

x) 与

A 统一为一个 参数

K(

x), 式(1) 可重新写为如下式(3)、式(4)、 式(5)所示 :

1.3 AOD-Net 网络结构

AOD-Net 的整体由两个部分组成,分别为 K 估计 模块和干净图像生成模块, K 估计模块通过输入的 I(x) 来估计出所需的 K(x), K(x) 作为干净图像生成模块的 输入参数,来估计出最后的输出 J(x)。K 估计模块是 AOD-Net 网络的主体组成部分,此模块用来估计图像 的深度和雾霾的相对水平。去雾流程如图 1 所示。

如图 2 所示, AOD-Net 基于卷积神经网络架构,总 共使用了 5 个卷积层,每个卷积层之间使用 3 个滤波 器,通过融合大小不同的滤波器来设计多尺度特征。在 图 2 中, “Conv1”和“Conv2”层的特征一起连接到 “Concat1”层, 同时, “Conv2”和“Conv3”的特征一起连接到“Concat2”层, 类似地, “Concat3”层连接 来自于“Conv1”“Conv2”“Conv3”和“Conv4”层的特 征, 通过“Conv5”估计出所需的

K(

x), 带入公式(4) 得到清晰的去雾图像。

2 算法改进

2.1 网络结构优化

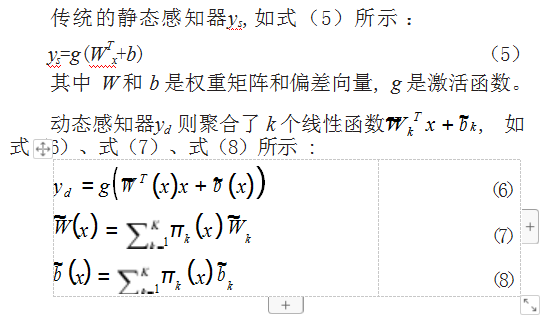

本文引入动态卷积代替 AOD-Net 网络中的普通卷 积,如图 3 所示。基于输入的注意力机制,动态卷积聚 合多个并行的卷积核。由于动态卷积使用的都是尺寸较 小的卷积核,所以拥有较高的计算效率,并且由于这些 卷积核聚集在一起的方式是非线性的,动态卷积拥有更 强的特征表示能力。

其中,

π 是第

k 个线性函数

WkT x +

bk 的权重向量,这个权重向量随着

x 的变化而变化。动态感知器

yd 是输 入的线性模型

ys 的组合,所以拥有更强的拟合能力。

2.2 注意力模块

ECA 注意力模块是基于 SENet[15] 改进的注意力模 块 , 该模块只增加了少量的参数,对于性能的增益却是 显著的。ECA 模块的结构信息如图 4 所示,该模块的 计算过程如下。

图 3 改进的 AOD-Net 网络结构

Fig.3 Improved AOD-Net network structure

这里的

σ 是 Sigmoid 函数,用于将缩放后的平均 值映射到(0,1)范围内的注意力权重。

(4)加权特征如式(12)所示 :

这里的 Ycij 是应用了注意力权重的特征值。

最后,得到经过 ECA 注意力加权的输出特征图。

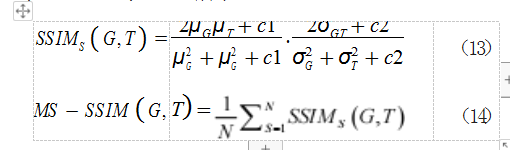

2.3 损失函数改进

AOD-Net 使用的是单一的均方误差损失函数来衡量 预测值与真实值之间的平方差,容易陷入局部最优解中。 本文采用 MS-SSIM-L2 损失函数 [16-19] 替换掉原来的均 方误差损失函数,用来提升整个网络的去雾性能。

(1)MS-SSIM(Multi-Scale Structural Similarity)。

首先,计算每个尺度的 SSIM 值,然后将它们加权平 均得到 MS-SSIM 值。尺度索引

s 通常情况下取 1 ~ n, 如式(13)、式(14)所示 :

最终的 MS-SSIM-L2 损失将 MS-SSIM 和

L2 损失加权组合起来,这里的

α 和

β 是权重系数,用于平衡 MS- SSIM 和

L2 损失的相对影响。

本小节提出的复合损失函数与之前的单一均方误差 损失函数相比,在亮度和对比度方面都有所提升,将其 选用为本文算法的最终目标损失函数。

3 实验结果与分析

3.1 实验环境

训练数据。由于在自然环境当中很难获取雾天模糊 图像和其对应的清晰图像,本文选取公开数据集 NYU2, NYU2 数据集包含原始清晰图像 1449 张以及对应的有 雾图像 27256 张,将图像按照 10 :1 的比例划分为训练集和验证集。同时选用 RESIDE[20] 的 SOTS(Synthetic Objective Training Set) 数据集和 HSTS(Hybrid Subjecive Testing Set) 数据集作为测试集。其中, SOTS 和 HSTS 当中分别包含 500 张合成的雾天图像和 10 张真实的雾 天图像。

实验环境,本文训练的硬件环境为 :CPU:AMDRyzen 7 5800H with Radeon Graphics ;GPU:NVIDIA GTX 3060 ;软件环境 :操作系统为 Windows 11 ;深度学习 框架 :Pytorch ;编译环境 :Pycharm。

3.2 评估指标

本文使用峰值信噪比 PSNR(Peak Signal-to-Noise Ratio)[21] 和结构相似 SSIM(Structural Similarity Index)[22] 两个指标来对图像的去雾效果进行客观评价。PSNR 是 一种用于测量图像质量的指标, PNSR 值越高,表示重 建图像与原始图像的相似性越高,而 SSIM 是一种比较 图像相似性的指标, SSIM 的值越接近 1,表示图像失 真越小。

3.3 实验结果与分析

本文选取 DCP、CAP、DehazeNet 和 AOD-Net 等 经典去雾算法与本文方法进行比较,来验证本文所提出 算法的有效性。在合成雾图数据集 SOTS 上的客观评价 如表 1 所示。

从表 1 中可以看出 DCP 和 CAP 算法作为传统的去 雾算法在两项指标上面与基于深度学习的去雾算法均有 差距, 去雾效果不强。AOD-Net 与 DehazeNet 两项指 标差距不大,本文所提出的算法与 AOD-Net 在两项指 标上相比,均有提升,并且从 SOTS 中选取部分合成雾 图进行测试,如图 5 所示。

从图 5 中可以看出, DCP 算法去雾后容易出现光晕, 而且图像明显变暗,对天空区域的去雾效果较差;CAP 算法 去雾效果也出现了过饱和, 去雾不够真实 ;DehazeNet 存在去雾不够均匀,去雾后的图像有色差。本文提出 算法与 DehazeNet 以及 AOD-Net 相比, 在去雾效果、 细节纹理和色彩还原上都有一定程度的提升。

由于真实雾天场景与合成雾图之间可能存在部分偏 差,本文从 HSTS 数据集当中选取真实世界的有雾图像 进行测试,如图 6 所示。从图 6 可以看出,本文改进的 算法在真实雾天场景下对于雾霾的去除和细节的还原上 都有一定程度的优化和改进,证明了本文算法的有效性。

4 结论

本文改进的 AOD-Net 单幅图像去雾算法将卷积层 替换为动态卷积,增加 ECA 注意力机制模块进行优化, 引入新的损失函数对亮度和对比度进行改进,在去雾能 力和细节还原上都有一定程度上的改进,无论从主观评 价还是客观指标上都取得了令人满意的效果。

参考文献

[1] 郑凤仙,王夏黎,何丹丹,等.单幅图像去雾算法研究综述[J]. 计算机工程与应用,2022,58(3):1-14.

[2] LIU P J, HORNG S J, LIN J S,et al.Contrast in Haze Removal:Configurable Contrast Enhancement Model Based on Dark Chan Nel Prior[J].IEEE Transactions on Image Processing,2019,28(5):2212-2227 .

[3] BUI M T, KIM W. Single Image Dehazing Using Color Ellipsoid Prior[J].IEEE Transactions on Image Processing,2018,27(2):999-1009 .

[4] MENG G F,WANG Y,DUAN J Y,et al.Efficient Image Dehazing with Boundary Constraint and Contextual Regu Larization[C]//In:Proceedings of the 2013 IEEE International Con ference on Computer Vision (ICCV). Sydney,Australia:IEEE,2013.617-624 .

[5] HE K M,SUN J,TANG X O.Single Image Haze Removal Using Dark Channel Prior[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33(12): 2341-2353.

[6] WANG Q R,ZHAO L,TANG G Y,et al.Single-image Dehazing Using Color Attenuation Prior Based on Haze- lines [C]//2019 IEEE International Conference on Big Data (Big Data).IEEE,2019:5080-5087 .

[7] BERMAN D,AVIDAN S.Non-local Image Dehazing[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2016:1674-1682 .

[8] CAI B L,XU X M,JIA K,et al.DehazeNet:An End-to-End System for Single Image Haze Removal[J].IEEE Transac tions on Image Processing,2016,25(11):5187-5198 .

[9] LI B Y, PENG X L,WANG Z Y,et al.AOD-net:All-in- one dehazing network[C]//2017 IEEE International Conference on Computer Vision(ICCV).Vision:IEEE, 2017:4770-4778 .

[10] CHEN Y P,DAI X Y,LIU M C,et al.Dynamic Convolution: Attention Over Convolution Kernels[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2020:11030-11039 .

[11] WANG Q L,WU B G,ZHU P C,et al.ECA-Net:Efficient Channel Attention for Deep Convolutional Neural Networks[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2020:11534-11542.

[12] NARASIMHAN S G, NAYAR S K.Vision and the Atmosphere[J]. I Nternational Journal of Computer Vision,2002,48(3):233-254 .

[13] NARASIMHAN S G, NAYAR S K . Chromatic Framework for vi sion in Bad Weather[C]∥Proceedings IEEE Conference on Computer Vision and Pattern Recognition.Hilton Head Is land:IEEE,2000:598-605 .

[14] QIAN W,ZHOU C,ZHANG D Y.Faod-net:AFast Aod- net for Dehazing Single image[J].Mathematical Problems in Engineering,2020:1-11 .

[15] HU J, SHEN L,SUN G.Squeeze-and-excitation networks[C]//2018 IEEE/CVF Conference on Computer Vision and PatternRecognition.Salt Lake City:IEEE, 2018:7132-7141 .

[16] LIU Y,ZHAO G.Pad-net:A Perception-aided Single Image Dehazing Network[J].2018 .

[17] WANG Z,BOVIK A C,SHEIKH H R,et al.Image Quality Assessment:from Error Visibility to Structural Similarity[J]. IEEE Transactions on Image Processing,2004,13(4):600- 612.

[18] ZHAO H,GALLO O,FROSIO I,et al.Loss Functions for Image Restoration with Neural Networks[J].IEEE Transactions on Computational Imaging,2016,3(1):4757 .

[19] WANG Z,SIMONCELLI E P,BOVIK A C.Multiscale Structural Similarity for Image Quality Assessment[C]// The ThritySeventh Asilomar Conference on Signals, Systems & Computers,2003(2):1398-1402 .

[20] LI B Y,REN W Q,FU D P,et al.Benchmarking Single- image Dehazing and Beyond[J].IEEE Transactions on Image Processing,2019,28(1):492-505 .

[21] AVCIBAS I,SANKUR B, SAYOOD K. Statistical Evaluation of Image Quality Measures[J].Journal of Electronic Imaging, 2002,11(2):206-223 .

[22] ZHOU W,BOVIK A C,SHEIKH H R,et al.Image Quality Assessment:from Error Visibility to Structural Similarity[J]. IEEE Trans Image Process,2004,13(4):600-612 .

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/75613.html