SCI论文(www.lunwensci.com)

摘 要:现阶段图像美学评估存在两个问题,首先网络模型复杂度高、参数量大 ;其次分别考虑图像的局部 ( 细粒度 ) 特 征和全局特征,忽视其美学相关性。为使高性能的美学评价模型在移动端部署成为可能,通过对比不同轻量化主干网络对实验 效果的影响,选取性能最优的轻量网络 MobilenetV2 作为基准网络,融合图像的浅层 ( 局部 ) 和深层 ( 全局 ) 特征进行特征增 强,提高网络模型对美学特征的理解。与先进美学评价模型相比,性能提升且参数量大幅减少,为美学评价模型在边缘设备上 的部署提供了新的研究思路。

Aesthetic Evaluation of Computer Image Based on Lightweight Network Model

LI Jian1. WANG Wenwen1. LI En2

(1.School of Electronic Information and Artificial Intelligence, Xi'an Shanxi 710021; 2.School of Design and Art, Shaanxi University of Science and Technology, Xi'an Shanxi 710021)

【Abstract】: There are two problems in image aesthetics evaluation at this stage. Firstly the network model has high complexity and a large number of parameters. Secondly the local (fine-grained) and global features of an image are considered separately, and their aesthetic relevance is ignored. In order to make it possible to deploy a high-performance aesthetic evaluation model on the mobile terminal, by comparing the influence of different lightweight backbone networks on the experimental results, the lightweight network MobilenetV2 with the best performance is selected as the benchmark network, and the shallow (local) and Deep (global) features are used for feature enhancement to improve the network model's understanding of aesthetic features. Compared with the advanced aesthetic evaluation model, the performance is improved and the number of parameters is greatly reduced, which provides a new research idea for the deployment of the aesthetic evaluation model on edge devices.

【Key words】: image quality assessment;computer image processing;computer aesthetics assessment;computer

0 引言

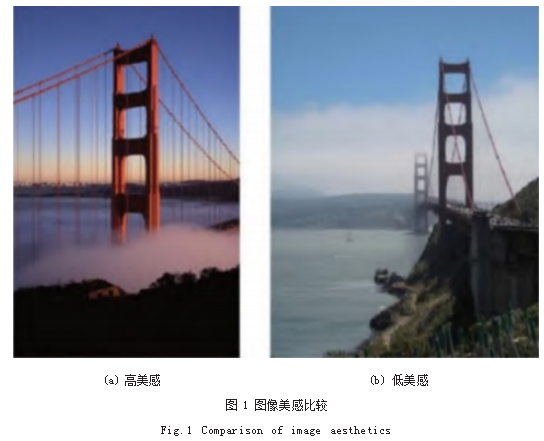

图像美学评价衡量了在人类眼中一幅图像的视觉吸 引力,由于图像美学评价是一个主观的属性,往往会涉 及情感和个人品味,这使得自动评估图像美学成为一项 非常主观的任务。然而,对于一幅图像的美感,人们往 往会达成一种共识,即一些图像在视觉上比其他图像更 有吸引力,这是新兴研究领域—可计算美学的原理之 一。如图 1 所示 , 拍摄同样一个场景,通常人们会认为 左边图的美感高于右边的图。使得计算机能够“发现图像美”并且“理解图像美”,是计算机视觉美学的研究 中活跃的研究主题。图像美学评价是一个具有挑战性和 实用性的感性问题 , 致力于利用计算机模拟人类的视觉 感知和美学思维,使用人工智能技术建立模型赋予计算 机可做出与人类相似的图像美学决策能力,在诸多领域 有着重要的应用。如,图像检索 [1]、相册管理 [2]、图像 增强 [3]、摄影的美学预测与修正、艺术作品风格分析、 人机交互 , 以及设计、摄影、广告等。相关研究涉及到 艺术、认知科学、心理学、计算机科学等多个学科,属于多学科交叉的创新性前沿研究课题 , 具有重要的理论 价值和应用前景。

提取图像的高级美学特征是进行图像美学评估的重 要步骤,早期的图像美学评价工作基于摄影规则手动提 取特征,然后再进行分类或者回归。随着卷积神经网 络在图像识别 [4]、目标检测 [5.6]、语义分割 [7] 领域的出 色表现, 自 AlexNet[8] 以来,以追求更高的准确率为目 标,大部分学者致力于设计更深、更复杂的卷积神经网 络模型,如 :GoogLeNet[9]、VGGNet[10]、ResNet[11] 等, 在各类任务上取得了良好的性能。基于端到端神经网络 的图像美学评价方法引起广泛关注,现有的图像美学评 价任务大多基于卷积神经网络进行,卷积神经网络能够 自动学习图像的低级和高级语义特征,从大量的训练图 像中学习和编码图像美学,对更复杂的图像特征及其关 系建模。因此,在图像美学评价领域也涌现了一批经典 的神经网络模型。但是,越深越复杂的设计结构,对 GPU 的要求就越高。以往的大多数美学评价模型复杂、 参数量大。而实际生活中的大多数美学评价任务需要在 有限的资源下实时计算,因此,设计轻量化的图像美学 评价模型使其在移动端和嵌入式设备上部署成为了迫切 需求。

本文通过对比不同轻量化主干网络对实验效果的影 响,选取性能最优的轻量化网络 MobilenetV2 进行改 进。主要贡献如下 :

(1)针对现有美学评价网络模型复杂,参数量大的 问题,提出美学评价的轻量化模型,模型参数量相较先 进模型减少 9.9 倍,为美学评价任务在移动端的应用提 供了新的研究思路。

(2)融合多层次特征,同时关注图像的局部 ( 细粒 度 ) 信息和全局信息,提高轻量化网络模型对图像美学 信息的理解。

1 相关工作

1.1 基于手工特征的美学评价方法

早期的图像美学评价工作通过设计过滤器来提取或 编码图像的低级特征,再使用回归或者分类器来训练模 型。Datta 等人 [12] 将图像的 RGB 格式转换为 HSV 格 式,设计了底层特征和高层特征共 56 种特征,从中选 择 15 种最有效的特征训练 SVM 分类器输出美学二分 类结果。Ke 等人 [13] 使用计算机视觉工具捕捉图像的高 级摄影概念,构造图像清晰度、曝光度、绚丽度等高 层语义特征,使用贝叶斯分类器输出美学二分类结果。 Luo 等人 [14] 从图像中提取主题区域,根据主题和背景 指定对比度、颜色、和谐度等高级语义特征,使用贝叶 斯分类器输出美学二分类结果。Mai 等人 [15] 遵守摄影 规则,使用显著图预测图像的显著区域,进行图像美学 评价。

早期的图像美学评价工作通过手工制作的特征来编 码图像美学信息,虽然取得了较好的结果,但是传统的手工设计特征受到摄影和心理学的启发,存在一定的局 限性。(1)设计手工特征需要专业人员从专业角度依据 专业的知识进行标注,标注的成本较高 ;(2)手工设计 特征的范围有限,较难做到量化和全面。

随着深度学习在各个领域的出色表现,现有的图像 美学评价大多基于卷积神经网络进行,卷积神经网络能 够自动学习图像的低级和高级语义特征,在美学评价任 务上取得了不错的表现。

1.2 基于卷积神经网络的美学评价方法

对于图像美学感知而言,人类视觉系统的美学评 估过程涉及许多因素,构图 [16] 和视觉平衡 [17] 是重要因 素 [18], 他们分别反应在图像全局和局部信息中。流行 的构图规则包括三分法则、对角线和黄金比例 [19] 等全 局信息。而视觉平衡则受位置、形式、大小、色调、颜 色、亮度、对比度等局部细粒度信息的影响。如何将图 像局部和全局信息相结合至关重要。

以往的图像美学评价模型提取高级美学特征时,会 分别考虑图像的局部和全局信息。Lu 等人 [20] 使用双列 神经网络并行输入裁剪的补丁和扭曲的图像,代表美学 评估中的局部和全局信息进行图像美学评价。但是一个 裁剪的补丁不能代表整张图片,为学习原始高分辨率图 像的细粒度信息, Lu 等人 [21] 提出深度多补丁聚合网络 (DMA-Net), 从一幅图像中裁剪多个补丁进行细粒度信 息的学习。MA 等人 [22] 提出自适应布局感知多补丁卷积 神经网络 (A-Lamp CNN) 架构,该网络使用多补丁子网 和布局感知子网学习图像局部 ( 细粒度 ) 信息和整体布 局。Zhang 等人 [23] 提出门控外围中央凹卷积神经网络 (gpf-cnn),由外围子网模仿外围视觉功能编码图像整 体信息并提供注意区域,中央凹子网提取关键区域的细 粒度信息。但是这些方法分别学习图像的细粒度特征和 全局特征,这可能会导致丢失视图的美学相关性 [24]。

此外,经典的美学评价模型多数使用 AlexNet[25]和 VGGNet[26] 作为基准网络,通常包含数百万个要学 习的参数 ( 也称为权重 ),例如, A-Lamp 架构的多补 丁子网由五列并行的 VGG16 组成, VGG16 具有 134M 个参数。这使得模型在计算时间和内存消耗方面非常苛 刻。而在实际应用场景中,美学评价模型需要在移动端 有限的计算环境下实时计算,为设计更高准确率、更轻 量的美学评价模型提出了新挑战。因此,如何在保持模 型精度的同时,降低模型的参数量和复杂度成为图像美 学评价模型的下一个挑战。接下来对轻量化网络进行简 单介绍。

1.3 轻量化网络

为适应计算机视觉模型在终端设备的应用,轻量化网 络可分为模型压缩和轻量化网络结构设计两大类。其中, 轻量化网络的设计是从模型本身出发, 采用深度可分离卷 积、分组卷积、1x1 卷积降维等轻量化的思想, 减少模型 的计算量。经典的轻量化网络模型包括 MobilenetV1[27]、 MobilenetV2[28]、SqueezeNet[29]、ShuffleNet[30] 等。

2 模型结构

2.1 高效的基准模型

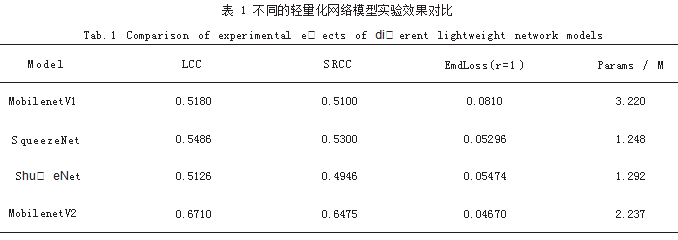

美学评价模型需要足够轻巧和高效,才能部署到资源 有限的设备上,区别于以前的工作 [20-22],采用参数量较大 的预训练卷积神经网络如 AlexNet[25]、VGG16[26] 等作为 基准模型。本文选择经典的轻量化网络 MobilenetV1[27]、 MobilenetV2[28]、SqueezeNet[29]、ShuffleNet[30] 在 AVA 数据集 [32] 上进行实验 (AVA 数据集介绍见 4.1.1 节 ), 移除神经网络最后的全连接 (FC) 层,添加 10 个神经 元的全连接层进行美学分数分布预测,统计相关性能指 标。与复杂的卷积神经网络相比,使用这种高效的轻量 化网络模型并不会牺牲太多的精度。轻量化网络模型实 验结果对比见表 1 所示。

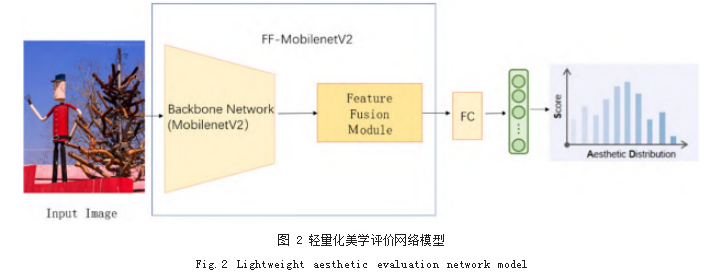

从实验结果可知, MobilenetV2 作为骨干网络模 型性能最优,因此使用 MobilenetV2 作为提取图像美学视觉特征的骨干网络,删除 MobilenetV2 的最后一 个全连接 (FC) 层 , 加入多层次特征融合模块 (Feature Fusion Module) 融合不同尺度的美学特征 , 添加新的 具有 10 个神经元的全连接 (FC) 层进行图像美学分布预 测,整体网络模型见图 2 所示。

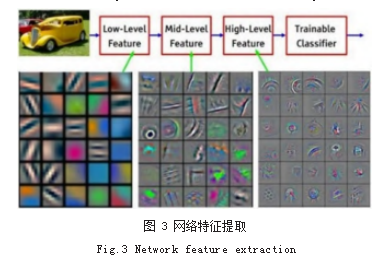

多层次特征融合模块 (Feature Fusion Module), 相比于传统的仅保留最后一层特征的模型,提取多层次 特征能同时保留神经网络中的局部和全局美学信息,提 升网络性能。见图 3 所示,对于卷积神经网络,由于 其自身的局限性,浅层网络主要提取到图像的纹理、颜 色、细节等细粒度特征,随着卷积神经网络深度的增 加,虽然能提取到更加丰富的语义信息,如图像的轮 廓、形状、构图等全局信息, 但是对图像的细粒度 ( 局 部 ) 信息感知能力较差。

因此,本文在特征提取过程中融合图像的浅层 ( 局 部 ) 和深层 ( 全局 ) 特征,产生多层次的特征表示,即同 时关注图像的局部和全局美学信息,增强图像美学特征 的表达能力。具体的,如图 4 所示,在 MobilenetV2 的 layer4、layer5、layer6、layer8、layer10 层添加 Neck (1x1Conv 256), 将特征的通道数调整为 256. 接着将卷积后的深度特征进行上采样与同尺度的特征相加。最 后上采样不同尺度的特征进行特征拼接得到不同层次的 美学特征。

2.2 损失函数

类似于文献 [32], 本文使用可以反应人们审美主观 的美学分数分布预测任务预测图像的美学评分分布,这 种分数分布模拟许多人的打分情况,得到的均值更贴合 人类的打分情况。

Talebi 等人首次提出预测分数分布代表图像美学 [31], 使用网络输出与真实直方图之间的距离损失作为损失函 数优化模型,所得的图像美学评分与人类感知高度相关。

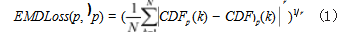

定义损失函数 EMDLoss 对轻量化网络进行优化,见 式 (1)。

p 是真实的概率, )p表示预测的概率。CDFp (k) 是累 积分布函数, r 是惩罚项。EMDLoss 可理解为使)p的分布接近p 的分布。

3 实验

3.1 AVA 数据集简介

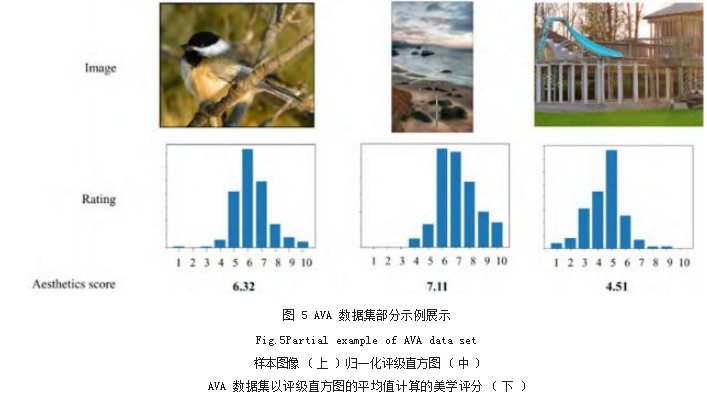

AVA[33] 数据集是目前公开的主流图像美学评价数据 集之一,总共包含 255300 张图片,平均每幅图被 210 人参与评分,评分范围为 1 ~ 10 分,平均分作为每张 图片的真值标签。整个数据集总共有 66 种文本形式的 语义标签, 14 个摄影属性标注,较全面的描述了摄影 爱好者感知理解美的方式,数据集部分用例展示如图 5 所示。本实验中,231000 张图片用作训练集,24300 张图片用作测试集。

3.2 实验环境

本实验在 Ubuntu16.04.4 LTS 64bit 系统环境下运 行,GPU 类型为 NVIDIA Tesla V100.16 核 32G, 搭载 600G 的硬盘, CPU 为 Intel Core Processor (Broadwell), python 版本为 3.6.2. 使用 1.10.2 版本的 pytorch 深度 学习开源框架,配合 CUDA10.2 进行训练。

3.3 实验设置

使用 SGD 优化器,权重和偏差动量设置为 0.90.学 习速率设置为 0.01.为了更容易更快的优化,使用 StepLR 机制调整学习率,每训练 10 个 epoch,对学习率应用具 有衰减因子 0.95 的指数衰减,batch-size 设置为 128. 3.4 评价指标为准确的衡量模型的性能,实验选取测试集真实评分与模型评分的皮尔森相关系数 (LCC)、斯皮尔曼秩相 关系数 (SRCC)、EMDLoss(r=1) 和参数数量 (Params) 作为评价指标,LCC 反映的是两个变量之间线性相关性 的强弱, SRCC 衡量模型的单调性, EMDLoss 是预测 图像美学分数分布任务的损失函数,反映预测值和真实 值之间的差异程度。Params 表示模型的参数量。LCC 和 SRCC 越大、EMDLoss 越小 , 表示模型的性能越好。

3.5 实验结果与分析

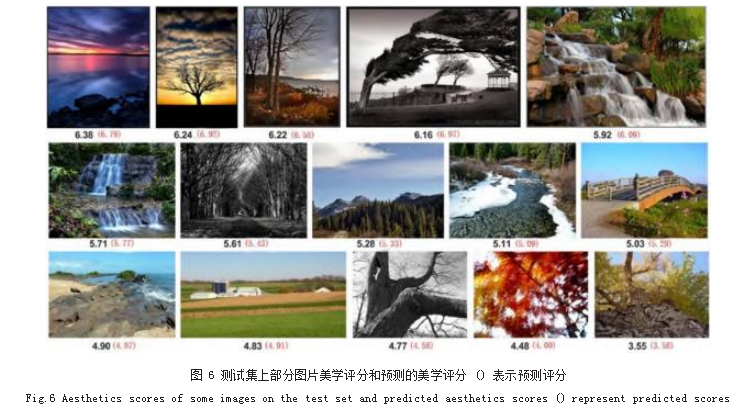

在 AVA 训练集上训练轻量化网络模型学习图像的 美学特征,使用测试集数据进行测试,如图 6 所示,为 该模型在测试集上的真实美学评分和预测的美学评分。 该结果说明,使用轻量化网络模型能学习到图像的美学 特征,对一幅图片进行美学评价能取得与真实评分相近 的结果。

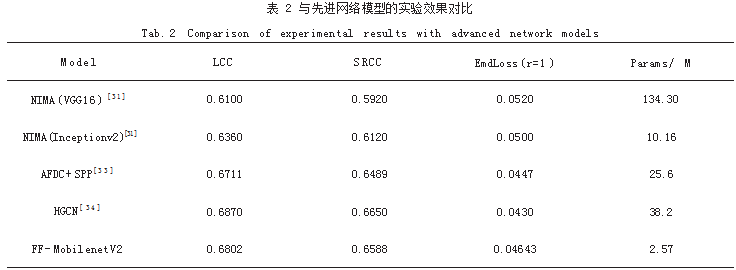

将本研究与现有的预测分数分布任务主流算法的性能 进行对比,从表 2 中可以看出,与主流网络模型 AFDC+ SPP[33] 相比,本研究使用的算法 LCC 和 SRCC 分别提升了 1.4%、1.5%, Params 减少 9.9 倍。相较于 HGCN 模型 [34], 各项性能略低,但是 HGCN 基于 ResNet-50. 模型参数量 为本模型的 14 倍。说明本文改进的模型在预测分数分 布任务上具有较好的性能和实用程度。

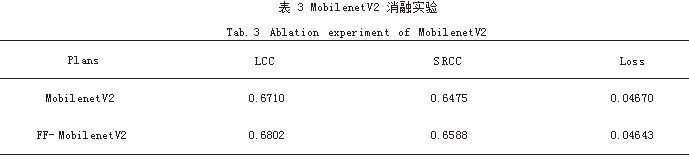

4 消融实验

以融合多层次特征,同时关注图像的局部和全局特 征能否提升轻量化网络模型的性能进行消融实验。具体 实验步骤如下 : 使用在 Imagenet 上预训练的权重初始 化 MobilenetV2 网络模型,在 AVA 美学评价数据集上训练并进行性能测试,将所得的结果作为基线指标,接 着加入多层次特征融合模块 (Feature Fusion Module) 进行实验记录相关性能指标,实验结果如表 3 所示。

从表中可以看出,融合了多层次特征的网络模型相 较于原 MobilenetV2. LCC 和 SRCC 分别提高了 1.4%, 1.5%, 该结果说明, 轻量化网络模型可以对复杂的图像特征及其关系建模。将浅层和深层信息融合,同时关 注图像的局部特征和全局特征,可以提高轻量化网络模 型对美学特征的理解。原因在于图像的整体颜色、深 度、光照和图像中物体的相对位置关系对图像美学评分 有较大的影响,网络模型的不同层代表着不同的美学信 息,将不同层的特征融合,模型能学习到图像复杂的美学特征表示。

5 结论

本研究针对以往的美学评价网络模型复杂、参数量 大的问题,提出轻量化美学评价网络模型。与先前的提 取图像局部信息和全局信息的美学评价模型不同,本文 对图像的局部和全局信息同时建模,在精度上与先进的 网络模型相近。但是本文提出的模型衡量大多数人对图 像的审美体验,由于人们在日常生活中对美的评判标准 存在较大差异,因此,研究针对特定用户的个性化图像 美学评价模型才可以满足当今社会与经济发展中人们对 个性化定制服务的需求。当前的研究主要面临着有限的 训练样本和美学评估的高度主观性两个挑战,现有的个 性化图像美学评价模型的研究还处于起步阶段,如何利 用有限的样本进行模型训练和提取描述用户主观特性的 有效特征是关键。

参考文献

[1] LU X,LIN Z,JIN H,et al.Rating Image Aesthetics Using Deep Learning[J].IEEE Transactions on Multimedia, 2015.17(11):2021-2034.

[2] DATTA R,LI J,WANG J Z.Learning the Consensus on Visual Quality for Next-generation Image Management[C]// Proceedings of the 15th ACM international conference on Multimedia,2007:533-536.

[3] HONG R,ZHANG L,TAO D.Unified Photo Enhancement by Discovering Aesthetic Communities from Flickr[J].IEEE Transactions on Image Processing,2016.25(3):1124-1135. [4] KRIZHEVSKY A,SUTSKEVER I,HINTON G E.Imagenet Classification with Deep Convolutional Neural Networks[J]. Communications of the ACM,2017.60(6):84-90.

[5] REN S,HE K,GIRSHICK R,et al.Faster R-CNN:Towards Real-time Object Detection with Region Proposal Networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2015.39(6):1137-1149.

[6] LIN T Y,GOYAL P,GIRSHICK R,et al.Focal Loss for Dense Object Detection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2020.42(2):318-327. [7] CHEN L C,PAPANDREOU G,KOKKINOS I,et al. Semantic Image Segmentation with Deep convolutional Nets and Fully Connected CRFs[J].Computer Science,2014 (4):357- 361.

[8] KRIZHEVSKY A.SUTSKEVER I.HINTON G E.Imagenet Classification with Deep Convolutional Neural Networks[C]//Advances in Neural Information Processing Systems,2012:1097-1105.

[9] SZEGEDY C.LIU W.JIA Y.et al.Going Deeper with Convolutions[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2015:1-9. [10] SIMONYAN K.ZISSERMAN A.Very Deep Convolutional Networks for Large-scale Image Recognition[J].arXiv preprint arXiv:1409.1556.2014.

[11] HE K,ZHANG X,REN S,et al.Deep Residual Learning for Image Recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2016:770-778.

[12] Ritendra Datta,Dhiraj Joshi,Jia Li,et al.Studying Aesthetics in Photographic Images Using a Computational Approach[C]//European Conference on Computer Vision (ECCV 2006)pt.3;20060507-13;Graz(AT),2006:288-301. [13] KE Y,TANG X O,JING F.The Design of High-level Features for Photo Quality Assessment[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2006.

[14] LUO Y W,TANG X O.Photo and Video Quality Evaluation: Focusing on the Subject[C]//International Conference on Computer Vision;ECCV,2008:386-399.

[15] LONG M,LE H,NIU Y,et al.Detecting rule of simplicity fromphotos[C]//AcmInternationalConferenceonMultimedia. ACM,2012.

[16] LITZEL O.In On Photographic Composition[M].New York:Amphoto Books,1974.

[17] Walter Niekamp.An Exploratory Investigation into Factors Affecting Visual Balance[J].Educational Technology Research&Development,1981.29(1):37-48.

[18] ARNHEIM R.Art and Visual Perception:A Psychology of the Creative Eye[J].University of California Press,1974. [19] JOSHI D,DATTA R,FEDOROVSKAYA E,et al.Aesthetics and Emotions in Images[J].IEEE Signal Processing Magazine, 2011 28(5):94-115.

[20] LU X,LIN Z,JIN H,et al.Rapid:Rating Pictorial Aesthetics Using Deep Learning[C]//Proceedings of the 22nd ACM International Conference on Multimedia, 2014:457-466.

[21] LU X,LIN Z,SHEN X,et al.Deep Multi-patch Aggregation Network for Image Style.aesthetics.and Quality Estimation [C]//Proceedings of the IEEE International Conference onComputer Vision,2015:990-998.

[22] MA S,LIU J,WEN CHEN C .A-lamp:Adaptive Layout- aware Multi-patch Deep Convolutional Neural Network for Photo Aesthetic Assessment[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2017:4535-4544.

[23] ZHANG X,GAO X,LU W,et al .A Gated Peripheral- Foveal Convolutional Neural Network for Unified Image Aesthetic Prediction[J].IEEE Transactions on Multimedia, 2019.21(11):2815-2826.

[24] XU M,ZHONG J X,REN Y,et al .Context- aware Attention Network for Predicting Image Aesthetic Subjectivity[C]//MM '20:The 28th ACM International Conference on Multimedia.ACM,2020.

[25] KRIZHEVSKY A,SUTSKEVER I,HINTON G E . Imagenet Classification with Deep Convolutional Neural Networks[J]Advances in neural information processing systems,2012.25(2).

[26] SIMONYAN K,ZISSERMAN A.Very Deep Convolutional Networks for Large-Scale Image Recognition[J].Computer Science,2014.

[27] HOWARD A G,ZHU M,CHEN B,et al .Mobilenets: Efficient Convolutional Neural Networks for Mobile Vision Applications[J].arXiv Preprint arXiv:1704.04861.2017. [28] SANDLER M,HOWARD A,ZHU M,et al .MobileNet V2:inverted Residuals and Linear Bottlenecks[C]// Proceedings of IEEE Conference on Computer Vision and PatternRecognition .Washington D.C .,USA:IEEEPress,2018:4510-4520.

[29] IANDOLA F N,HAN S,MOSKEWICZ M W,et al . SqueezeNet:AlexNet-level Accuracy with 50x Fewer Parameters and <0.5 MB model size[EB/OL].[2021-01-12]. https://arxiv.org/abs/ 1602.07360.

[30] ZHANG X,ZHOU X,LIN M,et al . ShuffleNet:An Extremely Efficient Convolutional Neural Network for Mobile Devices[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition .Washington D.C.,USA:IEEE Press,2018:6848-6856.

[31] TALEBI H,MILANFAR P. NIMA:Neural Image Assessment[J].IEEE Transactions on Image processing, 2018.27(8): 3998-4011.

[32] MURRAY N,MARCHESOTTI L,Perronnin F.AVA:A Large-scale Database for Aesthetic Visual Analysis[C]//2012 IEEE Conference on Computer Vision and Pattern Recognition.IEEE,2012:2408-2415.

[33] CHEN Q,ZHANG W,ZHOU N,et al.Adaptive Fractional Dilated Convolution Network for Image Aesthetics Assessment[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2020:14114- 14123.

[34] SHE D,LAI Y K,YI G,et al.Hierarchical Layout-aware Graph Convolutional Network for Unified Aesthetics Assessment[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition,2021:8475- 8484.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/61395.html