SCI论文(www.lunwensci.com):

摘 要:作为集成学习的重要组成部分,Boosting 类算法目前在机器学习领域受到广泛的关注。为了对 Boosting 类算法 的性能进行比较分析,本文以线上优惠券回收预测模型的研究为例,对比 Adaboost、GBDT、XGBoost 三种主流 Boosting 算 法在该分类问题上的拟合效果。并在其中选取拟合效果最好的算法代表 Boosting 类算法,与传统机器学习模型的拟合效果进 行对比分析。最终发现 XGBoost 在线上优惠券回收预测模型中的表现优于另外两种算法。

关键词:性能分析 ;线上优惠券回收预测模型 ;Boosting 类算法 ;极限梯度提升算法

Comparative Research on Boosting Algorithms:Taking Online Coupon Recovery Prediction for Example

ZHAI Dakun, MOU Wenlong

(School of Business and Tourism Management, Yunnan University, Kunming Yunnan 650091)

【Abstract】: As an important part of ensemble learning, Boosting algorithms are currently receiving extensive attention in the field of machine learning. In order to compare and analyze the performance of Boosting algorithms, this paper takes the study of online coupon recovery prediction model as an example to compare the fitting effects of the three mainstream Boosting algorithms Adaboost, GBDT, and XGBoost on this classification problem. The algorithm with the best combined effect represents the Boosting algorithm and compares with the traditional machine learning models. Ultimately, it is found that the performance of XGBoost is better than the other two algorithms on the stduy of online coupon recovery prediction model.

【Key words】: analysis of performance;online coupon recovery prediction model;Boosting algorithms;XGBoost

1 提升方法综述

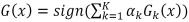

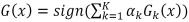

提升方法(Boosting)是一种应用广泛的统计学习 方法,其基本思想是将多个弱分类器按照一定的权重比 例集成一个强分类器。其中代表性的提升算法包括自适 应提升算法、梯度提升决策树算法、极限梯度提升算法 等。 自适应提升算法 (Adaptive Boosting,Adaboost) 由 Freund 等人于 1995 年提出 [1],该算法通过改变训练数据的概率分布,将多个弱分类器算法升为强分类器。 最终构建分类器

:

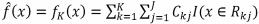

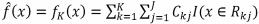

。梯度提升决策树 (Gradient Boosting Decison Tree, GBDT)[2] 利用损失函数负梯度在当前模型中的值,作为回归问题中提升树算法的近似值,进行回归树的拟 合。该算法由 Friedman JH 在 2001 年提出, 最终模型 :

。极限 梯度提升 (eXtreme Gradient Boosting, XGBoost)[3] 可

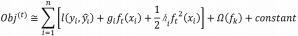

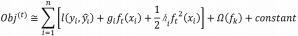

以看作是 GBDT 的改进版本,在 2014 年由陈天奇等人 首次提出。目标函数为 :

基于 Adaboost、GBDT、XGBoost 三种算法, 众 多学者完成了商业预测模型构建的工作。例如文献 [4] 提 出构建基于 Adaboost 强分类器的财务预警模型 ;文献 [5] 提出了基于 GBDT 等算法构建银行客户划分模型 ;文献 [6] 使用 XGBoost 算法构建商业销售预测模型。但是这些研究都没有利用具体商业问题实证研究三种 Boosting 类算法 的预测效果,也没有具体 比较Boosting 类算法与传统机器学习算法对某一问题拟合效果的优劣。本文以线上优惠券回收预测问题为例,对Boosting 类算法进行具体的性能分析。

2 数据描述与处理

2.1 数据描述

本文采取的数据集是阿里天池赛提供的真实线上消费行为的匿名数据,其中既包含用户优惠券使用、商家优惠券投放情况相关的具体数据,也包括用户购买行为的统计数据。前者称为数据集的特征,后者称为标签。其中一部分数据的特征与标签用于构建线上优惠券回收预测模型,另一部分数据的特征被投入到模型之中并得到预测结果,将预测结果与对应标签进行拟合,拟合的效果可评价模型的优劣。得到的模型可以预测某用户领取线上特定优惠券之后,是否会实施购买行为,帮助商家实现线上优惠券的精确投放,挖掘有意向使用优惠券实施购买行为的消费者。

2.2 特征选择

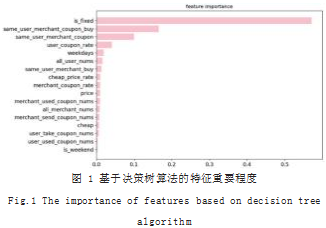

特征选择具有两个作用,第一个作用是减少特征维度,避免模型出现过拟合现象 [7],使得模型泛化能力更好 ;第二个作用是减少学习任务的难度,增加对于特征的理解。本文采用嵌入法进行特征选择,选取决策树算法进行模型拟合,然后根据拟合后各个特征的重要程度,选择合适的特征子集作为新的特征集合。

2.3 数据集划分

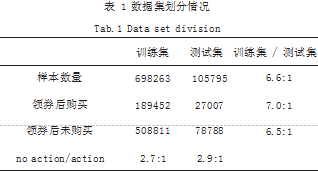

原数据集为2016年1月1日到2016年6月30日线上优惠券投放与使用情况汇总,将 20160101-20160530的数据作为训练集, 将 20160601-20160630 的数据作为测试集,划分结果如表 1 所示 :

由表 2 可知,经过上述划分数据集的操作,在训练集 与测试集当中的 no action/action 样本比例(6.5:1/7.0:1) 与样本总体比例 (6.6:1) 相差不大,相当于以 action 类别为指标,按一定比例进行抽样,基本符合分层随机 抽样 [8] 的特点。并且正负样本比例分别为 1:2.7/1:2.9, 并不存在样本不均衡的问题,不需要进行过采样或欠采 样等处理。

3 性能比较实证研究

完成数据集的初步处理之后,本文使用同等训练集 和特征集,使用 Boosting 类算法进行模型拟合,用构 建完成的模型对测试集数据进行预测研究,将预测的 action 标签与测试集中原有分类标签进行对比,以此区别分类性能的优劣,具体研究内容如下文所述。

3.1 特征选择实验研究

首先采用决策树算法对线上优惠券回收数据进行模 型拟合。在模型拟合之后获得不同特征重要性程度分别 如图 1 所示 :

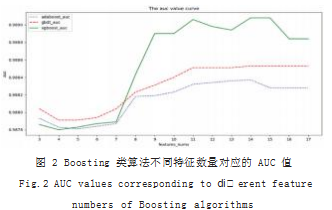

通过上图很容易的获得各个特征重要程度排序,设 W 为模型中的特征数量,本文选取不同的 W 值分别进 行实验,每次实验按照上表中特征重要性从上到下选 取 W 个特征进行 Boosting 模型拟合,最后从中选取 拟合效果(以 AUC 值作为评价指标)最好的 W 值作为 Boosting 模型中新的特征数量。W 取值为 3 到 17 时 的实验结果如图 2 所示 :

根据 Adaboost、GBDT、XGBoost 三种模型采用不同特征集合的拟合结果,按特征重要程度递减顺序选 取 14 个特征进行模型拟合时,三个模型的 AUC 值达到 最高。因此本文选取该特征子集作为新的特征集合用于模型拟合。

3.2 Boosting 类算法性能比较

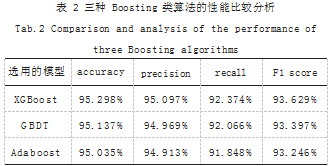

在获取到新的特征集合之后,下一步研究是在同等 外延条件下, 经调参处理后将 XGBoost、Adaboost、 GBDT 模型的拟合结果进行比较分析,具体的比较结果如表 2 所示 :

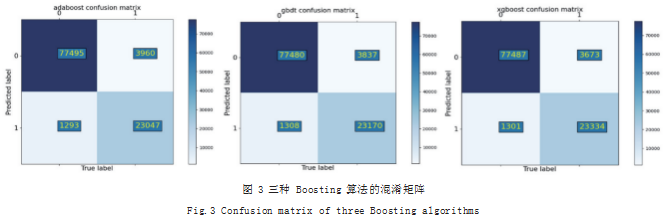

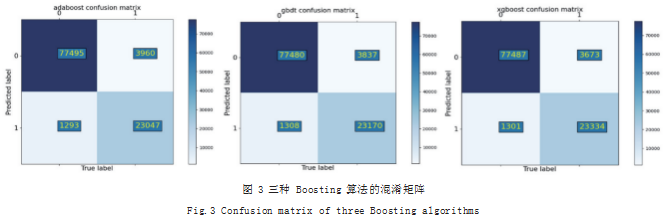

结合图 3 内容可知,总体上来说,对于线上优惠券 回 收 预 测 模 型 的 构 建,XGBoost、Adaboost、GBDT 三种算法拟合效果都比较好,AUC 值均能达到 98% 以 上,准确率、精确率、召回率、F1 值均在 90% 以上, 并且通过对混淆矩阵的观测 , 三种算法都能较高质量 的完成二分类任务。如果仔细分析三种算法可以发现, XGBoost 的各项评价指标均略高于 Adaboost 与 GBDT 算法,GBDT 算法表现也好于 Adaboost 算法。说明 在该批数据中,基于二阶泰勒展开公式与 L2 正则化的XGBoost 算法拟合效果更好,并且利用梯度下降理论的 GBDT 也略优于传统按照提升方法理念构建的 Adaboost 算法。通过上述的比较,对于线上优惠券回收预测问题 的研究,基于决策树算法进行特征选择的 XGBoost 模型在三种 Boosting 模型中拟合效果最优。

4 结语

本文利用提升方法的优势,以线上优惠券回收预 测模型构建为例,进行了特征选择、数据集划分、模 型性能对比等相关工作,完成了三种具有代表性的 Boosting 类算法性能比较,并得出结论 :以线上优惠 券回收预测模型为例, 在 Boosting 类算法性能比较分 析 的研究 中,XGBoost、GBDT、Adaboost 三种算法 性能总体差别较小,具体说来 XGBoost 算法拟合效果 最好,GBDT 算法略优于 Adaboost 算法。

参考文献

[1]李航.统计学习方法[M].北京:清华大学出版社,2012:155- 172.

[2] Friedman J H.Greedy Function Approximation: A Gradient Boosting Machine[J].Annals of Statisti cs,2001,29(5):1189-1232.

[3] Chen T,Guestrin C.XGBoost:A Scalable Tree Boosting System[C]//the 22nd ACM SIGKDD International Conference. ACM,2016.

[4] 刘一丁,徐静.基于Adaboost强分类器的财务预警模型[J]. 现代商业,2020(31):189-190.

[5] 秦振凯.基于树形算法的银行客户细分研究[D].重庆:重庆大 学,2017.

[6] 叶倩怡,饶泓,姬名书.基于Xgboost的商业销售预测[J].南昌 大学学报(理科版),2017(3):275-281.

[7] Rong M,Gong D,Gao X.Feature selection and its use in big data:challenges,methods,and trends[J].IEEE Access,2019(7):19709-19725.

[8] 邵颖丽.基于分层随机样本评估的简单随机抽样精度探讨 [J].统计与决策,2020(18):15-17.

关注SCI论文创作发表,寻求SCI论文修改润色、SCI论文代发表等服务支撑,请锁定SCI论文网!

文章出自SCI论文网转载请注明出处:https://www.lunwensci.com/jisuanjilunwen/34759.html

。梯度提升决策树 (Gradient Boosting Decison Tree, GBDT)[2] 利用损失函数负梯度在当前模型中的值,作为回归问题中提升树算法的近似值,进行回归树的拟 合。该算法由 Friedman JH 在 2001 年提出, 最终模型 :

。梯度提升决策树 (Gradient Boosting Decison Tree, GBDT)[2] 利用损失函数负梯度在当前模型中的值,作为回归问题中提升树算法的近似值,进行回归树的拟 合。该算法由 Friedman JH 在 2001 年提出, 最终模型 : 。极限 梯度提升 (eXtreme Gradient Boosting, XGBoost)[3] 可

。极限 梯度提升 (eXtreme Gradient Boosting, XGBoost)[3] 可